Deepfake studio приложение как работать

MALIVAR Studio — B2B сервис по подписке, который позволяет делать замену лица на видео автоматически. Делали для себя, теперь решили поделиться с креаторами, агентствами и брендам. Простым языком — это DeepFake на базе вымышленных героев или внешности реальных людей.

Вообще, мы в MALIVAR создаем виртуальных людей. Традиционный процесс анимации на базе компьютерной графики не всегда позволяет оперативно реагировать на изменения в соц сетях и быстро создавать контент. Хорошие 3д-ролики требуют времени и ручного труда дизайнеров. Поэтому еще год назад мы активно начали инвестировать в R&D по машинному обучению и разрабатывать собственные технологии. Как результат — появился отдельный сервис. Попробую рассказать как он работает на собственном примере. Кстати, забыла представиться, я Алиона Пол — виртуальный человек.

Не удивительно, что в техническом арсенале маркетинговых команд и продакшн студий на ряду с игровыми движками и генеративными нейросетками стали появляться и DeepFake решения. Такие ролики, как правило, создаются вручную разработчиками под конкретные проекты. Мы же предлагаем обрабатывать их самостоятельно в личном кабинете, что гораздо проще и понятнее нашим клиентам.

Началось все с того, что команда сгенерировала датасет на базе моей 3д-внешности и обучила нейросетку. Так появилась моя нейронная маска. По факту, при подготовке датасета неважно будет это реальный человек или вымышленный персонаж.

Синтетический датасет с мимикой виртуального персонажа Алионы ПолНам достаточно получить короткое видео на 30-60 сек с разнообразной мимикой от клиента, чтобы запустить процесс обучения пары "Носитель" (Source Actor) и "Маска" (Target Actor).

Пример обучения пары "Носитель" (Source Actor) и "Маска" (Target Actor)Дальше все просто — клиент получает доступ в личный кабинет, в котором уже самостоятельно может загружать и обрабатывать видео и фото автоматически. Ключевые слова здесь — автоматически и самостоятельно. Как я уже отмечала, большинство DeepFake проектов сейчас, это ручная работа/разметка под каждое видео или развлекательные приложения, где можно выбрать ролик из предложенных в низком разрешении. Подстройка нейронной маски под условия освещения на исходном видео происходит в нашем случае так же автоматически. При использовании MALIVAR Studio оплата производится по подписке.

Вы можете сыграть несколько ролей в своем собственном фильме, использовать образ исторической или вымышленной личности в рекламе, создать цифрового двойника реального селебрити, которого сложно регулярно привлекать к реальным съемкам. Вариантов масса, но мои любимые: музыкальный клип с DeepFake Steven Wilson - SELF (Official Video) и комедийное шоу Sassy Justice от создателей Южного Парка. Как еще можно использовать MALIVAR Studio:

- Использование образов исторических личностей

- Персонализация в рекламных коммуникациях

- Использование образов вымышленных персонажей

- Снижение стоимости создания контента со спец эффектами

- Комедийный контент и создание пародий

- Цифровые двойники артистов и селебрити

- Анонимность

Мы хотим, чтобы наши клиенты могли генерировать внешность по заданным параметрам с помощью нейронок и сразу использовать эти образы при создании DeepFake роликов. Ближайшие обновления будут касаться генерации лиц, голоса, а так же комментариев в стиле персонажей. Кроме того наша команда работает над новой технологией на базе машинного обучения, чтобы быстрее обрабатывать видео и точнее накладывать маску в экстремальных условиях освещения.

Различные методы манипулирования изображениями были введены в 19 веке и позднее применялись к кинофильмам. Эти методы быстро улучшились с цифровым видео.

В начале 1990-х годов исследователи из академических институтов разработали технологию Deepfake, которая впоследствии была доработана разработчиками в онлайн-сообществах. В последнее время подделки Deepfake привлекают большое внимание за их использование в финансовых махинациях, розыгрышах и фальшивых новостях.

Это заставило правительство и промышленность выявлять и ограничивать их незаконное использование. Тем не менее технология имеет большой потенциал, если ее правильно использовать.

Что такое технология Deepfake?

Deepfakes относятся к манипулируемому визуальному контенту, генерируемому сложным искусственным интеллектом, который дает сфабрикованные изображения и звуки, которые кажутся реальными. В большинстве случаев, человек в существующем видео или изображении заменяется на чье-то подобие.

Deepfakes создаются с использованием моделей глубокого обучения - подкласса методов машинного обучения, основанных на искусственных нейронных сетях с репрезентативным обучением. Он включает в себя обучение генеративных архитектур нейронных сетей, таких как генеративные состязательные сети или автоэнкодеры.

Хотя трудно создать хороший deepfake на обычном компьютере, есть много инструментов, доступных в интернете, чтобы помочь людям сделать достойные deepfakes. Технология все еще находится в зачаточном состоянии, поэтому не ожидайте идеального результата.

Мы тщательно собрали несколько хороших deepfake приложений и инструментов, которые не требуют высокого класса рабочего стола с мощными графическими картами (за исключением одного или двух). Вы можете использовать их как в исследовательских целях, так и просто для развлечения, но не нарушайте чью-либо частную жизнь.

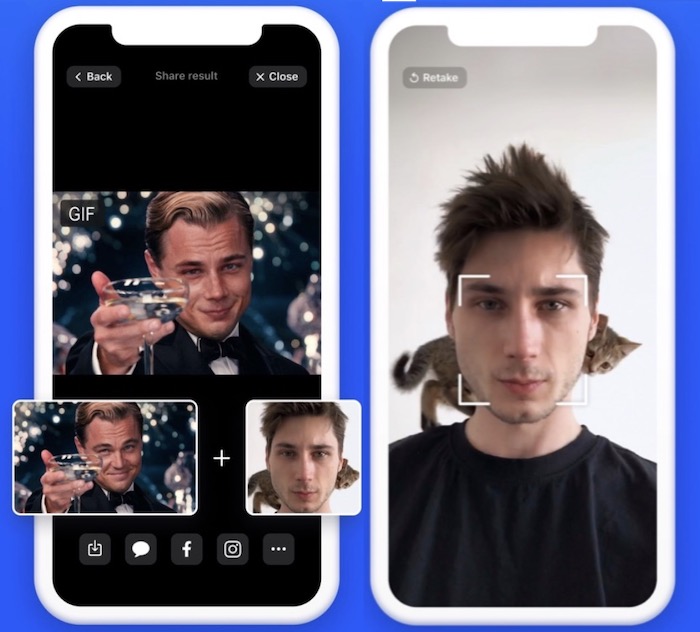

6. Doublicat

Платформа: Android / iOS

Цена: Бесплатно

Doublicat позволяет вам сделать селфи и поместить свое лицо на мем или GIF в своей библиотеке. Это займет около 5 секунд, чтобы ваше лицо было наложено на лицо Брэда Питта, Леонардо Ди Каприо или Тейлора Свифта.

Вы будете удивлены, увидев, насколько хорошо ваше наложенное лицо принимает те же выражения, что и оригинал. Вы можете переслать результаты своей семье и друзьям или опубликовать их в Instagram.

Вывод будет довольно странным, если будет много движений лица, но в целом это интересный эксперимент. По словам разработчиков приложения, само изображение удаляется с серверов сразу после его обработки. Однако при этом сохраняется представление черт лица.

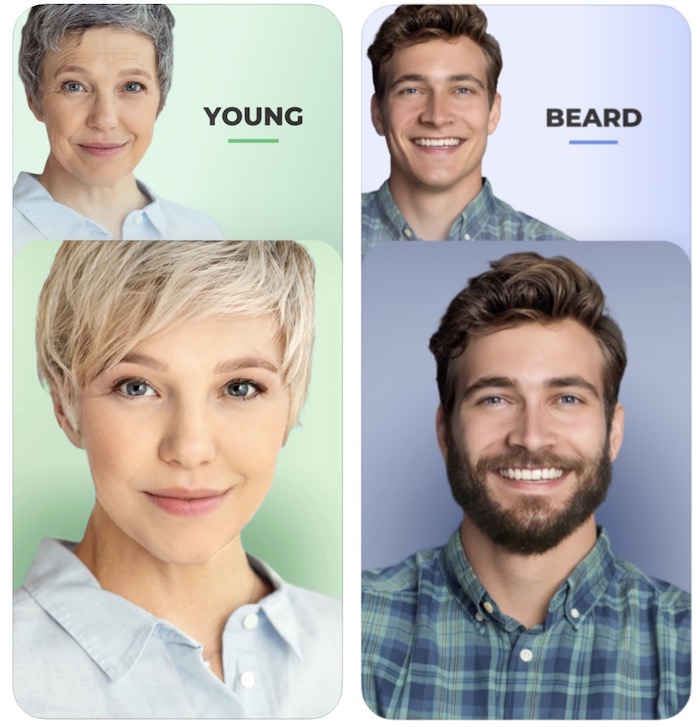

5. FaceApp

Платформа: Android / iOS

Цена: Бесплатно

FaceApp разработан российской компанией Wireless Lab. Он использует нейронные сети для генерации высокореалистичных преобразований лиц на фотографиях.

Приложение может преобразить ваше лицо, чтобы заставить его улыбаться, выглядеть старше, выглядеть моложе или просто смены пола, а также многих других захватывающих преобразований. Татуировки, виньетки, размытие объектива и наложение фона также являются частью FaceApp.

В 2018 году приложение привлекло много внимания со стороны трансгендерных и ЛГБТ-сообществ из-за его реалистичных преобразований гендерных изменений. Он также столкнулся с критикой как в социальных сетях, так и в прессе за конфиденциальность пользовательских данных.

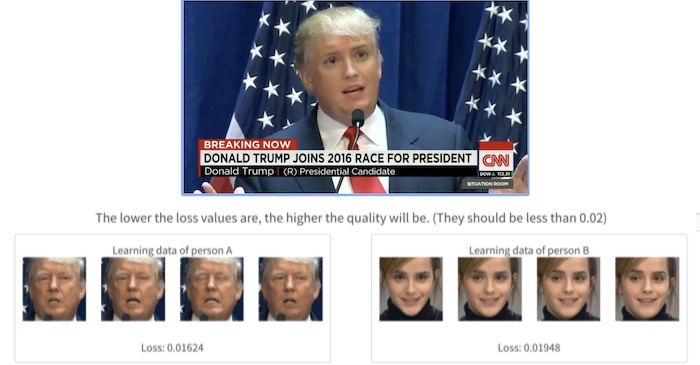

4. Deepfakes web β

Платформа: Сайт

Цена: $2 в час

С помощью этого инструмента вы можете создавать deepfake видео в интернете. Однако кривая обучения здесь немного больше, чем то, что вы найдете в других приложениях.

Вам нужно зарегистрироваться и загрузить свои видео. Все остальное происходит в облаке, где используются мощные графические процессоры. На изучение видео/изображений и смену лиц уходит почти 4 часа. Вы также можете использовать обученную модель, чтобы менять лица, что занимает около 30 минут.

Качество выходного видео зависит от значений "потерь": чем ниже значения потерь (при обучении из загруженных видео), тем выше качество. И, конечно, только вы можете получить доступ к своим видео и учебным данным.

3. DeepFaceLab

Платформа: Windows

Цена: Бесплатный

DeepFaceLab является ведущим программным обеспечением для создания подделок. Она использует новые нейронные сети для замены лиц в видео. Она размещена на GitHub и породила бесчисленное множество видео в интернете.

По словам его разработчиков, более 95% глубоких подделок видео создаются с помощью DeepFaceLab. Его используют несколько популярных каналов YouTube, таких, как Ctrl Shift Face, iFake и Shamook.

DeepFaceLab прекрасно работает, но для его использования необходимы технические знания. Как только вы загрузите и разархивируете инструмент, вы увидите множество папок и ряд командных файлов. Существует папка с именем "workspace", которая содержит все обучающие модели, исходные видео и выходные данные. Инструмент работает с определенными именами и местоположениями файлов, чтобы пакетный файл мог функционировать.

2. FaceSwap

Платформа: Windows | MacOS | Linux

Цена: бесплатно

FaceSwap похож на DeepFaceLab, но предоставляет больше возможностей, лучшую документацию и лучшую онлайн-поддержку. И да, он также доступен на Mac и Linux.

Это инструмент с открытым исходным кодом, наполненный функциональностью для выполнения каждого шага процесса Deepfake, от импорта первоначального видео до создания финального видео Deepfake. Чтобы запустить этот инструмент, вам нужна мощная видеокарта, так как замена лица происходит невероятно медленно.

Работая на Python, Keras и Tensorflow, Faceswap имеет активное сообщество, поддерживающее и разрабатывающее программное обеспечение. Есть много учебников, которые помогут вам начать работу.

1. Zao

Платформа: Android | iOS

Цена: бесплатно

Технология глубокой подделки Zao позволяет вам модулировать голоса знаменитостей и накладывать свое лицо на тело актера в сцене.

Просто нажмите на одну фотографию и попробуйте тысячи модных причесок, одежды и макияжа. Приложение предоставляет вам множество видеоклипов, нарядов и буквально неограниченные возможности для изучения.

В 2019 году Zao за короткое время приобрел значительную популярность, позволив пользователям обмениваться лицами с любимыми актерами в коротких клипах из телепередач и фильмов. За месяц он стал самым загружаемым бесплатным приложением в Китае. С ростом популярности, его разработчики также столкнулись с критикой политики конфиденциальности приложения.

Это займет всего несколько секунд, чтобы поменять ваше лицо, но так как алгоритм в основном обучен на китайских лицах, это может выглядеть не так естественно, как вы ожидаете.

Тем не менее все эти инструменты демонстрируют, как быстро развивался базовый ИИ: то, что раньше требовало тысячи картинок, чтобы сделать достаточно убедительное глубокое поддельное видео, теперь требует только одного изображения и дает лучшие результаты.

Deepfake – это специальная технология манипуляции с изображениями, позволяющая создать сфабрикованные фотографии, максимально приближенные к реальным. Впервые такие подделки были разработаны еще в начале 90-х, однако массово доступными они стали только сейчас. И сегодня отредактированные картинки активно используются мошенниками, папарацци и обычными пользователями соцсетей.

Немного о технологии

В основе Deepfakes лежит сложный искусственный интеллект, который генерирует изображения или звуки, создавая совершенно новые случайные образы. И чаще всего программа заменяет лицо человека чьим-то подобным.

Чтобы создать приложение, разработчики используют модели глубокого репрезентативного обучения, основанные на искусственных нейронных сетях.

На обычном компьютере создать качественный deepfake скорее всего не получится. Однако существуют приложения, позволяющие каждому попробовать данную технологию на себе и немного поиграть с различными изображениями.

Лучшие приложения и их использование

Чтобы не перебирать все приложения с технологией deepfake, можно воспользоваться нашей подборкой. Здесь перечислены лучшие ПО, с помощью которых можно сделать максимально реалистичную картинку на самом обычном компьютере или смартфоне. Полученные изображения следует использовать исключительно в исследовательских или развлекательных целях.

DeepFaceLab

Лучшим ПО для создания фотоподделок считается DeepFaceLab. Это бесплатная платформа для Windows, работающая на основе новейших нейронных связей. Она позволяет заменить лицо не только на фото, но и на видео. По статистике более 95% всех сфабрикованных видео создаются именно с помощью этой программы.

Посмотреть результаты можно на YouTube-каналах как Ctrl Shift Face, iFake и Shamook.

Чтобы воспользоваться DeepFaceLab, необходимо скачать утилиту на сайте GitHub. Однако следует учесть, что интерфейс программы достаточно сложный и без определенных технических знаний с ним не разобраться.

FaceApp

О приложении FaceApp, наверное, уже слышал каждый. Фото, сделанные в этой программе, стали вирусными в Инстаграм и Фэйсбук. С помощью FaceApp пользователи могут преобразить свое лицо до неузнаваемости: добавить улыбку, сделать его старше или младше и даже сменить пол.

В приложении есть как платные, так и бесплатные функции.

Пользоваться этой программой достаточно просто. Нужно лишь установить ее на телефон через PlayMarket и запустить. Далее нужно загрузить или сделать селфи и применить к нему понравившееся фильтры.

Zao – это бесплатная платформа для смартфонов, которая позволяет не только редактировать фото, но и монтировать видео. С ее помощью можно заменить собственный голос голосом любой знаменитости или наложить свое лицо на тело актера на сцене.

Редактируя фото, можно поменять прическу, одежду или макияж.

Максимальную популярность Zao приобрел в 2019 году. Тогда пользователи стали массово обмениваться смонтированными видео со своим лицом в популярных клипах из телепередач или фильмов.

FaceSwap

FaceSwap – программа для Windows, Mac и Linux с большими возможностями и функционалом. Для использования необходимо иметь хороший ПК с мощной видеокартой.

Также желательно обладать определенными техническими навыками. Однако, научившись в полной мере пользоваться FaceSwap, можно создавать максимально качественные и реалистичные deepfakes.

Doublicat

Очередное приложение для смартфонов с достаточно простым интерфейсом и неплохим функционалом. Всего за 5 секунд пользователь может наложить свое лицо на тело Бреда Питта или Анджелины Джоли. При этом выражение лица останется таким же, как у оригинала.

Возможности искусственного интеллекта постоянно расширяются и то, что раньше было только фантазией, сейчас стало реальностью. Примером этому являются многочисленные приложения с технологией deepfake. Они позволяют пользователям всего за пару кликов наложить свое лицо на тело любой знаменитости, получив максимально реалистичное изображение.

Эта небольшая заметка не про комплектующие или их разгон, а про первичное знакомство с ПО, которое помогает "утилизировать" мощь наших ПК для создания видео, получивших название DeepFake (и чем они мощнее - тем более качественный фейк мы сможем сделать за более короткое время). Это мой первый опыт написания "статьи", надеюсь блин выйдет не слишком уж большим комом. :)

DeepFake, DeepNude, Deep. - всё чаще слова с данным корнем звучат с экранов ТВ или пестрят в заголовках статей и блогов, заманивая сочной провокационной картинкой на обложке. Нейросети всё лучше учатся распознавать или изменять наши лица, тела, голоса. Всё труднее становится заметить эти подделки даже профессионалам. Источник скандалов и дискредитации известных персон, удел мошенников или просто обычное хобби и весёлый досуг? Всё зависит от чистоты помыслов людей, в чьих руках (особенно если прямых) оказывается подобное ПО. Моё внимание к данного рода программам привлекли видео, где Сталлоне остался "Один дома" и был вместо Арнольда в "Терминатор 2". Захотелось попробовать и узнать - насколько реально освоить это ремесло человеку, не обладающему знаниями в этой области, а также и не имеющему особых навыков использования фото- и видеоредакторов?! Попробуем разобраться вместе!

MSI RTX 3070 сливают дешевле любой другой, это за копейки Дешевая 3070 Gigabyte - цена падает из-за снижения крипты

Скачав данный пакет программ (DeepFaceLab) около недели назад, я был несколько ошарашен, ибо перед моим взором предстала следующая картина:

Однако постепенно, шаг за шагом изучая обучающие видео и pdf файл обучения, пробуя что-то с этим всем добром сделать, я понял, что это - большой труд, который проделал автор данного ПО, чтобы облегчить наше бремя создания видеофейков. Сильно глубоко вдаваться в сам процесс создания DeepFake (далее DF) не буду: для этого есть, уже упомянутые выше - видео на ютуб от автора, других умельцев и мануал (или писать отдельную статью). Но некоторые пояснения, которые возможно смогут помочь людям, решившим бросить вызов коварным нейросетям, я, с вашего позволения, попробую сообщить.

1. Про железо, куда же без него родного! Кроме очевидного (конец первого абзаца), тут есть некоторые нюансы: т.к. лимитирующим по времени этапом создания DF является тренировка нейросети (далее ИИ), которое происходит на видеокарте (CUDA предпочтительнее, но можно даже на встройке!), то именно её параметры будут нам важнее, чем CPU. Мощь ядра и большой объём VRAM - ускоряют процесс и позволяют использовать более "тяжёлые" настройки, влияющие как на скорость некоторых операций, так и качество итогового видеоматериала. Автор пакета выставил следующие требования к комплектующим:

Минимальные системные требования: Windows 7 и выше, процессор с поддержкой SSE инструкций, 2Gb ОЗУ с подкачкой, OpenCL-совместимая видеокарта (NVIDIA, AMD, Intel HD Graphics)

Рекомендуемые системные требования: Windows 7 и выше, процессор с поддержкой AVX инструкций, 8Gb ОЗУ, NVIDIA видеокарта 6GB видео памяти.

реклама

var firedYa28 = false; window.addEventListener('load', () => < if(navigator.userAgent.indexOf("Chrome-Lighthouse") < window.yaContextCb.push(()=>< Ya.Context.AdvManager.render(< renderTo: 'yandex_rtb_R-A-630193-28', blockId: 'R-A-630193-28' >) >) >, 3000); > > >);Из чего можно сделать вывод, что лучше использовать карты уровня GeForce GTX 1060 (и более поздние аналоги) для nVidia или AMD Radeon 470 и выше. Мой конфиг: Ryzen 7 1800X @ 4.0 GHz, GeForce GTX 1080 Ti.

2. Отбор видеоматериала источника лица и видео, из которого делают DF - огромное, если не решающее, влияние на итоговый результат. Лучше использовать FHD исходники, ну или уж хотя бы честный HD. Выбор персонажей для источника лица и под замену - второй кит, на котором держится успешность нашего фейка. Если вы заменяете, например, блондинку с прямыми волосами на брюнетку с пышными - есть не иллюзорный шанс получить плохую узнаваемость героя DF. Худых моделей легче "вписать" в толстых, что наверное логично. Есть конечно исключения - вдруг вы, наоборот, хотите довести фэйк до абсурда и вписываете специально какие-то нелепые соотношения моделей (старика в ребёнка и т.д.). Такой подход тоже вполне имеет право на жизнь! Последний этап "пробоподготовки" - тщательно проверить: какие лица выделил детектор лиц, а он выделяет ВСЮ массовку! И приходится переназначать такие кадры вручную. Тренироваться лучше начинать на простых сценах, где 1 человек, и он более менее статичен: пресс-конференции, монологи и всё в таком духе. По мере увеличения способностей, повышать сложность сцены. Ещё очень важный момент при отборе лиц: SRC - это лицо, которые мы хотим вставить. DST - лицо, заменяемое в нашем фэйке. SRC лицо - нужно очень серьёзно "просеивать": удалять кадры, где чем-то закрывается лицо, размытые, смазанные и т.д. Оставлять только чёткие! А DST наоборот - нам нужны абсолютно все кадры с данным лицом, а иначе потом будут пропуски кадров, и настоящий герой видео будет возвращаться в фэйк.

3. Тренировка ИИ. Сложный процесс, имеющий кучи, непонятных не только новичку, но и чуть более опытным пользователям, настроек (в продвинутых моделях), поэтому лучше начинать либо с H64 или с DF (в данном случае это название модели для тренировки), т.к. они проще. Хотя можно запускать и более сложные модели, такие как SAE и SAE HD, в режиме "по умолчанию", главное чтобы хватило VRAM, иногда надо снижать некоторые параметры. Тренировать ИИ рекомендуют ОТ одного дня. Но на картах уровня 1080ti и выше, на мой взгляд, это время можно сократить, но исходя из результата, который выводится на экран в процессе тренировки. Пример:

реклама

Выложу свой стандартный алгоритм создания DF, который поможет в самостоятельном освоении:

- 2) extract images from video data_src (источники лиц - им заменяют)

- 3.2) extract images from video data_dst FULL FPS (лицо, которое будет заменено)

- 4) data_src extract faces S3FD all GPU (детектирование лиц источника)

- [4.1) data_src check result] (удаляем всех левых персонажей, ошибочные кадры - крупные массивы фото, остальное отсеем позже)

- 4.2.2) data_src sort by similar histogram

- 4.1) data_src check result

- 4.2.1) data_src sort by blur

- 4.1) data_src check result (удалить мутные)

- 4.2.6) data_src sort by best (автоматика сама отбирает лучшие лица и удаляет ненужные, можно сразу использовать только этот пункт и потом вручную проверить, не осталось ли там "неликвида")

- 5) data_dst extract faces S3FD all GPU (детектирование лица "под замену")

- [5.1) data_dst check results]

- 5.2) data_dst sort by similar histogram

- 5.1) data_dst check results

- 5.3) data_dst sort by blur (Ручная проверка и удаление кадров, где несколько лиц или не совсем корректно определены контуры нужного лица в папке DeepFaceLab\workspace\data_dst\aligned_debug).

- 5) data_dst extract faces MANUAL RE-EXTRACT DELETED

RESULTS DEBUG (восстановление удалённого и последующая ручная разметка маски лица) - 6) train SAE HD (тренировка модели, можно брать другую использовав соответвующий *.bat файл)

- 7) convert SAE HD (замена dst лица на src, используя натренированную ранее модель)

- 8) converted to mp4 ("склеивание" стоп-кадров в видео)

Здесь "2) extract images from video data_src" - это "батник" "2) extract images from video data_src.bat" из папки "DeepFaceLab" и т.д. Эх, наверное сумбур уже пошёл, и я тут чутка перегрузил терминами, которые сложно воспринимать без подробного описания, а писать полную статью с подробным описанием всех действий - я в данный момент не потяну. При просмотре самых вводных видео от автора ПО - многое встанет на свои места. Если не хотите пока забивать голову, можно бегло пробежать по видео ниже, чтобы понять приблизительный уровень DF у человека, который неделю (плотно) пытался разбираться в этом вопросе. И сделать какие-то выводы о дальнейшей целесообразности самостоятельных попыток создания DeepFake видео.

Вывод: за неделю ознакомиться с данным пакетом можно, но получить реально хороший уровень фэйков - тяжело (если конечно вы не гений :)), потому что многие параметры моделей можно подбирать только эмпирическим путём или общаясь с более опытными фэйкерами, например, на рутрекере.

Привожу варианты своих "работ", чтобы вы могли оценить приблизительный уровень и некий прогресс в динамике обучения. Если она вообще имеется конечно. Все видео приводить не буду, можно поглядеть на моём канале. Только основные вехи.

Самое первое видео, его исходники идут в комплекте DeepFaceLab, т.е. и предназначены для первых тренировок (файлы data_dst.mp4 и data_src.mp4 в папке "DeepFaceLab\workspace", свои видеофайлы вы в дальнейшем должны называть также, чтобы программа их подхватывала и использовала).

Тут особо и комментировать нечего, ляп на ляпе. По сути, я в тот момент просто жал почти везде "Enter" и всё было в режиме "по умолчанию", т.к. я ещё мало что понимал и не умел менять настройки (модели масок, цветовые и почти все прочие). Это делается уже почти в конце, на этапе "7) convert SAE HD" из алгоритма выше. Время тренировки модели - около 3-4 часов.

Далее пошёл этап набивания шишек (я многие из них уже озвучил ранее): когда наше видео по качеству хуже чем источник - получается, что очень сильно заметны грани заменённого лица. Один раз я не заметил, что детектор не взял некоторые лица, и они потом исчезли в видео. Выбор слишком сложных динамических сцен, совершенно разное освещение SRC и DST лиц - тоже получается слишком "топорная" вставка.

Пример ошибки со вставкой Поклонской в Шурыгину - она довольно тяжело узнаётся из-за совсем разных причёсок и цвета волос:

Тут на миг пропадает лицо Греты (замена на неизвестную широкой общественности журналистку):

Ну и в самом конце, самый последний фэйк, который закончил только сегодня - тренировал 16 часов, личный рекорд пока что. Само обращение очень сочное, хорошего качества, а мой источник лица немного не дотягивает до такого уровня детализации и цветопередачи, возможно если продолжить тренировку модели с некоторыми другими настройками - его качество ещё можно поднять:

Если кого-то заинтересовала данная тема - скачивайте DeepFaceLab, устанавливайте и вперёд! Какие-то моменты могу попробовать подсказать, но в Интернете достаточно подробных рукописных и видеогайдов.

Читайте также: