Способ реализации параллельных вычислений путем использования множества компьютеров тест

Первый вопрос, на который следует дать ответ, - какие вычисления программы на компьютере следует называть параллельными. Но это не единственный вопрос, на который хотелось бы получить ответ. Не менее важно понять, зачем вообще переходить из простого, хорошо знакомого, понятного мира последовательных вычислений к сложному для понимания миру параллельных вычислений. Какие преимущества есть у параллельных вычислений, и какие проблемы ждут программиста при создании программ, ориентированных на параллельные вычисления. Чтобы ответить на эти вопросы, давайте совершим небольшой экскурс в историю развития компьютеров.

Первые компьютеры были построены в соответствии с принципами, сформулированными Фон-Нейманом. Они имели три главных компонента - память , процессор и некоторый набор внешних устройств, обеспечивающих ввод и вывод информации.

Память была многоуровневой и для первых компьютеров содержала внешнюю память и внутреннюю память - оперативную и регистровую. Внешняя память (на магнитных лентах, перфокартах, дисках) позволяла сохранять программы и данные вне зависимости от того, включен компьютер или нет. Внутренняя память хранила информацию только на период сеанса работы с компьютером. При отключении компьютера содержимое внутренней памяти исчезало.

Для того чтобы программа могла быть выполнена на компьютере, она должна была быть загружена в оперативную память . Хранилась она там точно также как и данные, обрабатываемые этой программой. Принцип хранимой в памяти программы - один из главных принципов Фон-Неймановских компьютеров.

Регистровая память использовалась в момент выполнения вычислений. Прежде, чем выполнить некоторую операцию над данными, данные должны быть размещены на регистрах. Этот самый быстрый вид памяти обеспечивал необходимое быстродействие при выполнении операций над данными.

Выполнение всех операций - операций над данными и операций по управлению процессом вычислений - осуществлял процессор . Процессор компьютера обладал определенным набором команд. Этот набор был достаточно универсальным, чтобы вычислить любую потенциально вычислимую функцию. С другой стороны этот набор обеспечивал относительную простоту написания программ человеком.

Программы для первых компьютеров представляли последовательность команд, входящих в допустимый набор команд процессора. Выполнение программы на компьютере осуществлялось достаточно просто. В каждый момент времени на компьютере выполнялась одна программа . Процессор , в соответствии с программой, последовательно выполнял одну команду за другой. Все ресурсы компьютера - память , время процессора, все устройства - были в полном распоряжении программы, и ничто не могло вмешаться в ее работу (не считая конечно человека). Параллелизма не было и в помине.

Такая идиллия продолжалась недолго по причине неэффективного использования ресурсов крайне дорогих в те времена компьютеров. Компьютеры тогда не выключались, - одна программа сменяла другую.

Достаточно скоро у компьютера наряду с процессором, который стал называться центральным процессором, появились дополнительные процессоры, в первую очередь специализированные процессоры устройств ввода-вывода информации, отвечающие за выполнение наиболее медленных команд. Это дало возможность организации пакетного режима выполнения программ, когда на компьютере одновременно выполнялись несколько программ - одна программа могла печатать результаты работы, другая - выполняться, третья - вводить необходимые ей данные, например с магнитной ленты или другого внешнего носителя.

Революционным шагом было появление в 1964 году операционной системы фирмы IBM - OS 360. Появившаяся у компьютера операционная система стала его полновластным хозяином - распорядителем всех его ресурсов. Теперь программа пользователя могла быть выполнена только под управлением операционной системы. Операционная система позволяла решить две важные задачи - с одной стороны обеспечить необходимый сервис всем программам, одновременно выполняемым на компьютере, с другой - эффективно использовать и распределять существующие ресурсы между программами, претендующими на эти ресурсы. Появление операционных систем привело к переходу от однопрограммного режима работы к мультипрограммному, когда на одном компьютере одновременно выполняются несколько программ. Мультипрограммирование это еще не параллельное программирование , но это шаг в направлении параллельных вычислений.

Мультипрограммирование - параллельное выполнение нескольких программ. Мультипрограммирование позволяет уменьшить общее время их выполнения. Под параллельными вычислениями понимается параллельное выполнение одной и той же программы. Параллельные вычисления позволяют уменьшить время выполнения одной программы.Заметим, что наличие у компьютера нескольких процессоров является необходимым условием для мультипрограммирования. Существование операционной системы, организующей взаимную работу процессоров, достаточно для реализации мультипрограммирования. Для параллельных вычислений накладывается дополнительное требование - это требование к самой программе, - программа должна допускать возможность распараллеливания вычислений.

Появление операционной системы означало, что компьютер нельзя рассматривать только как "железо" ( память , процессоры, другие устройства). Теперь у него две составляющие - хард ( hard ) и софт ( soft ) - аппаратная и программная составляющие, взаимно дополняющие друг друга. За полвека существования компьютеров оба компонента стремительно развивались.

Для аппаратуры характерен экспоненциальный рост, что нашло отражение в известном эмпирическом законе Мура, - экспоненциально росли все важнейшие характеристики - объем памяти на всех уровнях, уменьшение времени доступа к памяти, быстродействие процессоров. Согласно закону Мура (Гордон Мур - один из основателей фирмы Intel) каждые полтора года значения характеристик увеличивались вдвое. Росло и число процессоров, включаемых в состав компьютера. Изменялась и архитектура компьютера . Эти изменения во многом были шагами в сторону распараллеливания вычислений. Вот лишь некоторые изменения в архитектуре процессоров, связанные непосредственно с процессом распараллеливания:

- Конвейерная обработка команд. Процесс выполнения потока команд процессором уже не рассматривался как последовательное выполнение команды за командой. Обработка потока команд выполнялась на конвейере, так что сразу несколько команд готовились к выполнению. При конвейерной обработке команды, не связанные между собой по данным, могли выполняться одновременно, что является уже настоящим параллелизмом.

- "Длинные команды". Архитектура некоторых компьютеров включала несколько процессоров, позволяющих выполнять логические и арифметические операции над целыми числами, несколько процессоров, выполняющих операции над числами с плавающей точкой. Длинная команда позволяла указать в одной команде действия, которые должен выполнить каждый из существующих процессоров. Опять таки, это позволяло реализовать параллелизм на аппаратном уровне.

- Векторные и матричные процессоры. В набор команд таких процессоров включаются базисные операции над векторами и матрицами. Одной командой, например, можно сложить две матрицы. Такая команда фактически реализует параллельные вычисления. Приложения, где эти операции составляют основу обработки данных, широко распространены. Реализуемая аппаратно параллельная обработка данных позволяет существенно повысить эффективность работы приложений этого класса.

- Графические процессоры. Еще одним важным видом приложений, где на аппаратном уровне происходит параллельное выполнение, являются приложения, интенсивно работающие с графическими изображениями. Эту обработку осуществляют графические процессоры. Графическое изображение можно рассматривать как набор точек. Обработка изображения зачастую сводится к выполнению одной и той же операции над всеми точками. Распараллеливание по данным легко реализуется в такой ситуации. Поэтому графические процессоры давно уже стали многоядерными, что позволяет распараллелить обработку и эффективно обрабатывать изображение.

- Суперкомпьютеры. К суперкомпьютерам относят компьютеры с максимальными характеристиками производительности на данный момент. В их состав входят сотни тысяч процессоров. Эффективное использование суперкомпьютеров предполагает самое широкое распараллеливание вычислений.

В научных исследованиях и в новых технологиях всегда есть задачи, которым требуется вся мощь существующих вычислительных комплексов. Научный потенциал страны во многом определяется существованием у нее суперкомпьютеров. Понятие суперкомпьютера это относительное понятие. Характеристики суперкомпьютера десятилетней давности сегодня соответствуют характеристикам рядового компьютера. Сегодняшние суперкомпьютеры имеют производительность , измеряемую в петафлопсах (10 15 операций с плавающей точкой в секунду). К 2020 году ожидается, что производительность суперкомпьютеров повысится в 1000 раз и будет измеряться в экзафлопсах.

Классификация компьютеров

Мир компьютеров многообразен, начиная от миниатюрных встроенных компьютеров до многотонных суперкомпьютеров, занимающих отдельные здания. Классифицировать их можно по-разному. Рассмотрим одну из первых и простейших классификаций - классификацию Флинна, основанную на том, как устроена в компьютере обработка данных. Согласно этой классификации все компьютеры (вычислительные комплексы) можно разделить на четыре класса - компьютеры с архитектурой:

- SISD (Single Instruction stream - Single Data stream) - одиночный поток команд - одиночный поток данных. К этому классу относятся обычные "последовательные" компьютеры с фон-Неймановской архитектурой, когда команды программы выполняются последовательно, обрабатывая очередной элемент данных.

- SIMD (Single Instruction stream - Multiple Data stream) - одиночный поток команд - множественный поток данных. К этому типу относятся компьютеры с векторными и матричными процессорами.

- MISD (Multiple Instruction stream - Single Data stream) - множественный поток команд - одиночный поток данных. К этому типу можно отнести компьютеры с конвейерным типом обработки данных. Однако, многие полагают, что такие компьютеры следует относить к первому типу, а компьютеры класса MISD пока не созданы.

- MIMD (Multiple Instruction stream - Multiple Data stream) - множественный поток команд - множественный поток данных. Класс MIMD чрезвычайно широк и в настоящее время в него попадают многие компьютеры достаточно разной архитектуры. Поэтому предлагаются другие классификации, позволяющие более точно классифицировать компьютеры, входящие в класс MIMD.

Мы не будем рассматривать подробную классификацию компьютеров класса MIMD. Остановимся только на другом способе разделения компьютеров на три класса:

Презентация по информатике «Развитие архитектуры вычислительных систем».

Направления развития архитектуры вычислительных систем определяются:

требованиями увеличения скорости и объемов обработки информации; - требованиями большей эффективности; - появлением новых технических возможностей.

Просмотр содержимого документа

«Развитие архитектуры вычислительных систем.»

Презентация на тему: «Развитие архитектуры вычислительных систем»

1)Зачем нужны сверхбыстрые компьютеры

2)Основной цикл работы ПК

4)Варианты реализации параллельных вычислительных систем

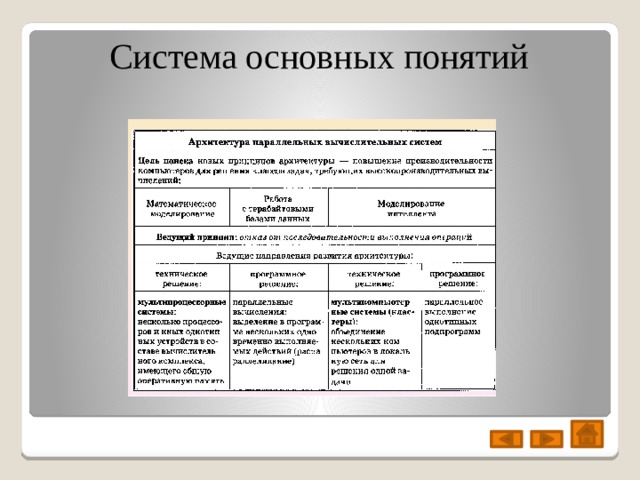

5)Система основных понятий

Зачем нужны сверхбыстрые компьютеры

1.Математические расчеты, лежащие в основе реализации математических моделей многих процессов.

2.Поиск информации в гигантских базах данных, достигающих по объему хранимой информации нескольких терабайтов.

3.Моделирование интеллекта. Объем оперативной памяти ПК в разы больше памяти человека.

Компьютер четвертого поколения

Основной цикл работы ПК состоит из следующих этапов:

1)Процессор считывает очередную команду программы;

2)Эта команда расшифровывается, из оперативной памяти извлекаются указанные в ней данные, над ними выполняется требуемое действие;

3)Результаты действия записываются в оперативную память (если действие того требует) и все повторяется заново, пока не произойдет остановка по какой-то причине.

Дано: есть массив из 100 чисел a1,a2,…a100

Варианты реализации параллельных вычислительных систем

Параллельные вычисления - процессы обработки данных, в которых одновременно могут выполняться несколько машинных операций.

Распределенные вычисления - способ реализации параллельных вычислений путем использования множества компьютеров, объединенных в сеть. Такие вычислительные системы еще называют мультикомпьютерными системами .

Распределенные вычисления часто реализуются с помощью компьютерных кластеров.

Компьютерные кластеры - несколько компьютеров, связанных в локальную сеть и объединенных специальным программным обеспечением, реализующим параллельный вычислительный процесс.

Распределенные вычисления могут производиться и с помощью многомашинных вычислительных комплексов , образуемых объединением нескольких отдельных компьютеров через глобальные сети.

Мультипроцессорная система реализуется в одном компьютере. Достижение параллелизма в ней происходит благодаря возможности независимой работы отдельных устройств.

Мультипроцессорная система может использовать разные способы доступа к общей для всей системы памяти.

Все процессоры могут иметь равный доступ к единой памяти (к такому типу относятся мощнейшие в мире суперкомпьютеры семейства Cray).

Компьютер семейства «Cray»

Система основных понятий

Список использованной литературы

1)Информатика и ИКТ. Базовый уровень: учебник для 10-11классов / И. Г. Семакин, Е. К . Хеннер. – 5-е изд. - М.: БИНОМ. Лаборатория знаний. 2009. – 246 с. : ил.

Учащиеся должны знать: этапы истории развития ЭВМ; что такое неймановская архитектура ЭВМ; для чего используются периферийные процессоры (контроллеры); архитектуру персонального компьютера; основные принципы архитектуры суперкомпьютеров.

Задачи:

Образовательные – ознакомить учащихся с этапами развития ЭВМ; дать понятие архитектуры персонального компьютера; объяснить основные принципы архитектуры суперкомпьютеров;

Развивающие – развивать творческую и мыслительную деятельность учащихся на уроке посредством анализа демонстрационных примеров, способность к обобщению, быстрому переключению, способствовать формированию навыков коллективной и самостоятельной работы, умения чётко и ясно излагать свои мысли;

Воспитательные – способствовать развитию смысловой памяти, умений анализировать, сравнивать, отбирать материал, формированию поисковой самостоятельности и коммуникативных качеств учащихся.

| Вложение | Размер |

|---|---|

| Информационные процессы в компьютере | 117 КБ |

| Информационные процессы в компьютере | 1.35 МБ |

Предварительный просмотр:

Урок с применением технологий:

Тема урока: «Информационные процессы в компьютере»

Учащиеся должны знать: этапы истории развития ЭВМ; что такое неймановская архитектура ЭВМ; для чего используются периферийные процессоры (контроллеры); архитектуру персонального компьютера; основные принципы архитектуры суперкомпьютеров.

Образовательные – ознакомить учащихся с этапами развития ЭВМ; дать понятие архитектуры персонального компьютера; объяснить основные принципы архитектуры суперкомпьютеров;

Развивающие – развивать творческую и мыслительную деятельность учащихся на уроке посредством анализа демонстрационных примеров, способность к обобщению, быстрому переключению, способствовать формированию навыков коллективной и самостоятельной работы, умения чётко и ясно излагать свои мысли;

Воспитательные – способствовать развитию смысловой памяти, умений анализировать, сравнивать, отбирать материал, формированию поисковой самостоятельности и коммуникативных качеств учащихся.

- Организационный момент.

- Проверка домашнего задания. Опрос по теме «Автоматическая обработка информации».

- Приведите примеры процессов обработки информации, которые чаще всего вам приходится выполнять во время учёбы. Для каждого примера определите исходные данные, результаты и правила обработки. К каким видам обработки относятся ваши примеры?

- Если вы решаете задачу по математике или физике и при этом используете калькулятор, то какова ваша функция в этом процессе и какова функция калькулятора?

- Используя алгоритм Евклида, найдите НОД для чисел 114 и 66. Сколько шагов алгоритма при этом вам пришлось выполнить?

- Какие проблемы решает теория алгоритмов?

- Почему калькулятор нельзя назвать алгоритмической машиной, а компьютер можно?

Карточка с заданием (письменно – 3-4 учащихся):

- Придумайте минимально необходимую систему команд для кассового аппарата, который подсчитывает стоимость покупок и сумму сдачи покупателю. Опишите алгоритм управления работой такого автомата.

- Новая тема. «Информационные процессы в компьютере».

Как уже известно: (слайд 2-4)

- Компьютер (ЭВМ) – автоматическое, программно-управляемое устройство для работы с информацией.

- В состав компьютера входят

- устройства памяти (хранение данных и программ)

- процессор (обработка информации)

- устройства ввода/вывода (приём/передача информации)

- В 1946 году Джоном фон Нейманом были сформулированы основные принципы устройства ЭВМ, которые называют фон-неймановской архитектурой. Для неймановской архитектуры характерно наличие одного процессора, который управляет работой всех остальных устройств.

- Современный компьютер представляет собой единство аппаратуры (hardware) и программного обеспечения (software).

Серийное производство ЭВМ начинается в разных странах в 1950-х годах. Историю развития ЭВМ принято делить на поколения.

Переход от одного поколения к другому связан (слайд 5-6)

- со сменой элементной базы, на которой создавались машины

- с изменением архитектуры ЭВМ

- с развитием основных технических характеристик (скорости вычисления, объема памяти и др.)

- с изменением областей применения и способов эксплуатации машин.

с 1970-х годов (ПК, суперЭВМ)

Интегральные схемы (ИС) и большие интегральные схемы (БИС)

БИС, СБИС (сверхбольшие интегральные схемы), микропроцессоры

Максимальное быстродействие (оп./с)

Появление периферийных процессоров

Центральный процессор + каналы ввода/вывода.

Конвейерно-векторные, матричные, многопроцессорные, мультикомпьютерные системы

Однопроцессорная архитектура ЭВМ. (слайд 7-11)

Сплошные стрелки – передача данных

Пунктирные стрелки – управляющее воздействие

Согласно принципам фон Неймана, исполняемая программа хранится во внутренней памяти – в оперативном запоминающем устройстве (ОЗУ). Там же находятся данные, с которыми работает программа. Каждая команда программы и каждая величина (элемент данных) занимают определённые ячейки памяти:

- Процессор начинает выполнение программы с первой команды и заканчивает на команде остановки, назовём её STOP.

- При выполнении очередной команды процессор извлекает из памяти обрабатываемые величины и заносит их в специальные ячейки внутренней памяти процессора – регистры .

- Затем выполняется команда, после чего полученный результат записывается в определённую ячейку памяти.

- Процессор переходит к выполнению следующей команды.

- Исполнение программы закончится, когда процессор обратится к команде STOP.

Среди команд программы существуют: (слайд 12-14)

- Команды обработки данных

- Команды обращения к внешним устройствам

Команды обработки данных выполняет сам процессор с помощью входящего в него арифметико-логического устройства – АЛУ, и этот процесс происходит сравнительно быстро.

А команды управления внешними устройствами выполняются самими этими устройствами: устройствами ввода/вывода, внешней памятью. Время выполнения этих команд во много раз больше, чем выполнения команд обработки данных.

При однопроцессорной архитектуре ЭВМ процессор, отдав команду внешнему устройству, ожидает завершения её выполнения. При большом числе обращений к внешним устройствам может оказаться, что большую часть времени выполнения программы процессор «простаивает» и, следовательно, его КПД оказывается низким.

Быстродействие ЭВМ с такой архитектурой находилось в пределах 10-20 тыс. операций в секунду.

Использование периферийных процессоров. (слайд 15-19)

Сплошные стрелки – передача данных

Пунктирные стрелки – управляющее воздействие

Треугольника – периферийные процессоры управления внешними устройствами

Следующим шагом в развитии архитектуры ЭВМ стал отказ от однопроцессорного устройства. Уже на последних моделях машин второго поколения, помимо центрального процессора (ЦП), выполнявшего обработку данных, присутствовали периферийные процессоры , которые назывались каналами ввода/вывода.

Их задача состояла в автономном управлении устройствами ввода/вывода и внешней памяти, что освобождало от этой работы центральный процессор.

В результате КПД центрального процессора существенно возрос. Быстродействие некоторых моделей машин с такой архитектурой составило от 1 до 3 млн. оп./с.

На всех моделях ЭВМ третьего поколения использовалась архитектура с одним процессором и периферийными процессорами внешних устройств.

Такая многопроцессорная архитектура позволяла реализовать мультипрограммный режим работы: пока одна программа занята вводом/выводом данных, которым управляет периферийный процессор, другая программа занимает центральный процессор, выполняя вычисления.

Благодаря совершенствованию элементной базы и других аппаратных средств на некоторых моделях ЭВМ третьего поколения достигалось быстродействие до 10 млн. оп./с.

Для разделения ресурсов ЭВМ между несколькими выполняемыми программами потребовалось создание специального программного обеспечения: операционной системы (ОС) . К разделяемым ресурсам, прежде всего, относятся время работы центрального процессора и оперативная память. Задачи ОС состоит в том, чтобы разные программы, выполняемые одновременно на ЭВМ, не мешали друг другу и чтобы КПД центрального процессора был максимальным, иначе говоря, чтоб ЦП не «простаивал». ОС берёт на себя так же заботу об очерёдности использования несколькими программами общих внешних устройств: внешней памяти, устройств ввода/вывода.

Архитектура персонального компьютера. (слайд 20-23)

Появление ПК связано с созданием микропроцессоров, которое началось в 1970-х годах. До недавнего времени в устройстве ПК существовал один центральный процессор и множество периферийных процессоров, управляющих внешними устройствами, которые называются контроллерами .

Сплошные стрелки – направление потоков информации

Пунктирные стрелки – направление управляющих сигналов

Для связи между отдельными функциональными узлами ПК используется общая информационная магистраль , которая называется системной шиной .

Системная шина состоит из трёх частей:

- Шина данных (для передачи данных)

- Шина адреса (для передачи адресов устройств, которым передаются данные)

- Шина управления (для передачи управляющих сигналов, синхронизирующих работу разных устройств)

Важное достоинство такой архитектуры – возможность подключения к компьютеру новых устройств или замена старых устройств на более современные. Это называется принципом открытой архитектуры . Для каждого типа и модели устройства используется свой контроллер, а в составе операционной системы имеется управляющая программа, которая называется драйвером устройства.

Открытая архитектура персонального компьютера – это архитектура, предусматривающая модульное построение компьютера с возможностью добавления и замены отдельных устройств.

Важное событие в совершенствовании архитектуры ПК произошло в 2005 году: был создан первый двухъядерный микропроцессор. Каждое ядро способно выполнять функции центрального процессора. Эта особенность архитектуры позволяет производить на ПК параллельную обработку данных, что существенно увеличивает его производительность.

Архитектура ненеймановских вычислительных систем. (слайд 24-30)

Ведущий принцип: отказ от последовательного выполнения операций.

Есть массив из 100 чисел. Требуется найти их сумму.

Первый вариант (для 1-го человека): последовательно сложить все числа.

Это пример последовательного вычислительного процесса .

Второй вариант (для 25 человек):

- Распределить по два числа на человека, чтоб каждый посчитал сумму своих чисел

- Полученные 50 чисел снова распределить по два числа на человека, чтоб каждый посчитал сумму своих чисел

- Так продолжать до тех пор, пока не останется одно число – искомая сумма

Это пример распараллеливания вычислений .

Для реализации подобной схемы компьютеру потребуется 25 процессоров, объединённых в одну архитектуру и способность работать параллельно.

Такие многопроцессорные вычислительные комплексы – реальность сегодняшней вычислительной техники.

Но, вернёмся к нашему примеру. В нём есть ещё источники проблем.

При записи в память компьютера суммы каждой пары чисел произойдет одновременное обращение 25 процессоров к системной шине. Но поскольку шина одна, числа по ней могут пересылаться только по одному. А для этого нужно организовать очередь на передачу чисел в память. Тут же возникает вопрос: не сведёт ли к нулю эта очередь все преимущества параллельности выполнения операций. А если преимущества останутся, то насколько они велики? Окупятся ли расходы на 24 дополнительных процессора?

В возникшей ситуации естественен следующих шаг «изобретательской мысли»: ввод в архитектуру нескольких системных шин. А если ещё подумать над возможными проблемами, то и нескольких устройств оперативной памяти.

Обсуждаемые изменения в устройстве компьютера приводят к «ненеймановским» архитектурам .

Варианты реализации ненеймановских вычислительных систем. (слайд 31-33)

В самом общем смысле под параллельными вычислениями понимаются процессы обработки данных, в которых одновременно могут выполняться несколько машинных операций. Параллельные вычисления реализуются как за счёт новой архитектуры вычислительной техники, так и за счёт новых технологий программирования. Такие технологии называют параллельным программированием .

Распределённые вычисления – способ реализации параллельных вычислений путём использования множества компьютеров, объединённых в сеть. Такие вычислительные системы ещё называют мультикомпьютерными .

Распределённые вычисления часто реализуются с помощью компьютерных кластеров – нескольких компьютеров, связанных в локальную сеть и объединённых специальным программным обеспечением, реализующим параллельный вычислительный процесс.

Распределённые вычисления могут производиться и с помощью многомашинных вычислительных комплексов , образуемых объединением нескольких отдельных компьютеров через глобальные сети.

Мультипроцессорные системы образуют единый компьютер, который относится к классу суперкомпьютеров . Достижение параллелизма в них происходит благодаря возможности независимой работы отдельных устройств и их дублирования: несколько процессоров, блоков оперативной памяти, шин и т.д. Мультипроцессорная система может использовать разные способы доступа к общей для всей системы памяти. Если все процессоры имеют равный (однородный) доступ к единой памяти, то соответствующая вычислительная система называется векторным суперкомпьютером .

Один из самых мощных в мире суперкомпьютеров под названием «Ломоносов» произведён в России и работает в Московском государственном университете. Его быстродействие составляет более ста триллионов операций в секунду.

Направления развития архитектуры вычислительных систем определяются требованиями большей эффективности и скорости обработки информации; появлением новых технических возможностей

Направления развития архитектуры вычислительных систем определяются

требованиями большей эффективности и скорости обработки информации;

появлением новых технических возможностей.

Задачи сверхбыстрых компьютеров: математические расчёты, лежащие в основе реализации математических моделей многих процессов

Задачи сверхбыстрых компьютеров:

математические расчёты, лежащие в основе реализации математических моделей многих процессов.

поиск информации в гигантских базах данных, достигающих по объёму хранимой информации нескольких терабайтов.

моделирование интеллекта.

Как можно ускорить работу компьютера?

Как можно ускорить работу компьютера?

У компьютера имеется много внешних устройств. Но только один, нацеленный непосредственно на выполнение программы процессор, одна шина и одна оперативная память.

Развитие архитектуры вычислительных систем

Неймана. многопроцессорные вычислительные комплексы

распараллеливание вычислений – процессы обработки данных, в которых одновременно могут выполняться несколько машинных операций;

принципиально новые архитектуры, отличные от архитектуры фон Неймана.

многопроцессорные вычислительные комплексы

Развитие архитектуры вычислительных систем

Распределённые вычисления - способ реализации параллельных вычислений путём использования множества компьютеров, объединённых в сеть

- способ реализации параллельных вычислений путём использования множества компьютеров, объединённых в сеть.

мультикомпьютерные системы

Кластеры несколько компьютеров, связанных в локальную сеть и объединённых специальным программным обеспечением, реализующим параллельный вычислительный процесс

несколько компьютеров, связанных в локальную сеть и объединённых специальным программным обеспечением, реализующим параллельный вычислительный процесс.

многомашинные вычислительные комплексы

Мультипроцессорная система- реализуется на одном компьютере

Мультипроцессорная система- реализуется на одном компьютере

Все процессоры имеют равный (однородный) доступ к единой памяти.

Cray – мощнейшие в мире суперкомпьютеры.

Читайте также: