Когда будет восстание компьютеров

В самом начале форума "Армия-2021" была поставлена важнейшая из проблем безопасности государства: Либо Россия создаст собственную концепцию развития интернета и искусственного интеллекта, либо мы потеряем управленческий контроль и проиграем страну в ходе ментальной войны.

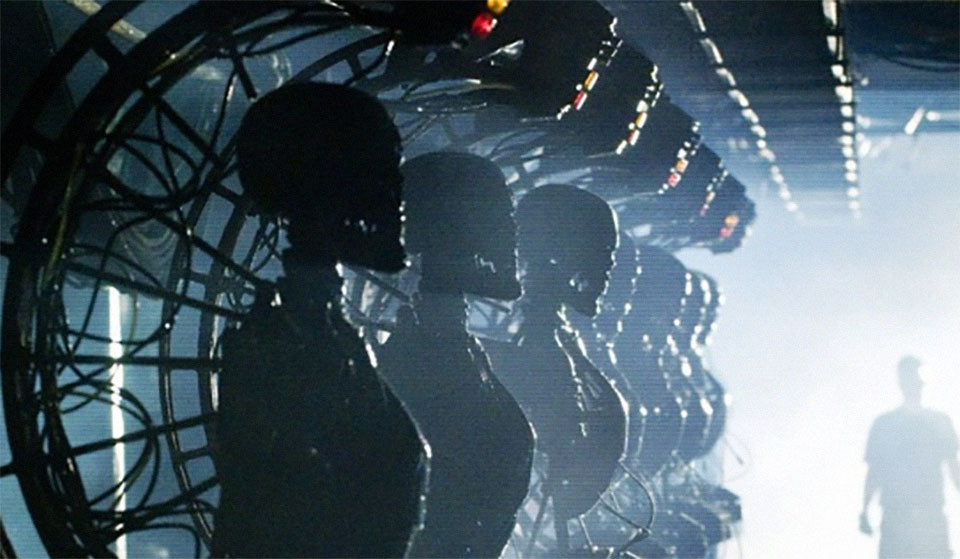

Знаменитый и даже, наверное, великий русский писатель-фантаст Сергей Лукьяненко недавно поделился с читателями своими впечатлениями от нового романа американского фантаста Маргарет Уэлс. Речь идёт о серии романов о "киллерботе" - роботе, созданном для убийства и охраны особо важных персон, но осознавшем себя личностью и сбежавшем от хозяев. Возможно, именно с лёгкой руки Лукьяненко этот роман набирает в России популярность. Но гораздо важнее, что этот "киллербот" представляет собой что-то вроде квинтэссенции современных обывательских представлений об искусственном интеллекте: когда речь заходит об ИИ, обыватель немедленно представляет себе "восстание машин" в диапазоне от классического "Я, робот" Айзека Азимова до голливудского Терминатора и его противников. Обывателю немножко страшно, немножко интересно, иногда страшно интересно, однако обыватель помнит, что то, о чём он читает и чего побаивается, – это фантастика.

Между тем ИИ – это уже некоторое время не фантастика (даже "ближнего прицела"), а совершено реальные разработки, которыми занимаются в ведущих в научном и техническом отношении странах мира, в том числе и в России. Результаты некоторых из этих разработок взаимодействуют с тем самым обывателем, который побаивается "восстания машин" каждый день. За несколько последних лет мы привыкли к "умным" вещам, которые даже разговаривают с нами на манер роботов из фантастических книг прошлого.

"Умными" теперь бывают, например, музыкальные колонки и пылесосы. Буквально каждый из нас носит в кармане "умное" устройство, заменившее обычный телефон. Это устройство (и не оно одно, просто оно всегда с нами) собирает о нас огромное количество разнообразной информации и делится этой информацией с другими устройствами. Незаметно для нас, безо всякого контроля с нашей стороны.

Параллельно мы взаимодействуем с искусственным интеллектом в интернете. ИИ предлагает нам информацию, которая, как он решает на основе анализа массивов относящихся к нашим данным, соответствует нашим потребностям. ИИ осуществляет цензуру, в соответствии со своей программой отсеивая информацию, которая нам, по его мнению, не нужна. ИИ беседует с нами – и тест Тьюринга можно считать устаревшим, потому что сплошь и рядом многие неглупые люди не могут отличить в социальных сетях ботов от живых собеседников.

Восстания машин нет и не предвидится, но происходящее сегодня уже очень опасно. Для отдельного человека, для государства и в конечном итоге для всего человечества.

Об этом говорили первоклассные специалисты на конференции "Гуманитарные и социокультурные аспекты применения искусственного интеллекта", которая открывала научную программу форума "Армия-2021".

Мы на войне, перед нами противник

Советник министра обороны и модератор конференции Андрей Ильницкий в своём выступлении заострил внимание на простом, казалось бы, факте: искусственный интеллект – это технология двойного назначения или попросту военная технология. И она широко применяется сегодня против России в ходе ментальной войны. Смысл действий противника в том, чтобы подменить с помощью информационного воздействия базовые ценности народа. Управляя новостными потоками, целые общества можно сподвигнуть к принятию решений, принципиально противоположных настоящим интересам и потребностям этих обществ. Эту опасность нельзя переоценить.

Между тем обращение с ИИ в самой России чревато многочисленными рисками. ИИ внедряют в систему управления с излишним энтузиазмом, как будто руководствуясь принципом "надо ввязаться в драку, а там посмотрим". Необходимо в ближайшее время формировать российскую философию и концепцию интернета и ИИ. Иначе мы упустим управленческий контроль и затем проиграем страну,

Что касается опасности имитации институтов, второй модератор дискуссии Наталья Касперская заметила: по некоторым данным, в Китае сегодня до 90% научных (!) статей пишутся ботами и являются в некотором смысле фейками. А государства и отдельные университеты всё ещё меряются рейтингами цитируемости своих учёных…

Риски, вызовы и угрозы

Сказать, что Россия отстает от Запада в деле развития ИИ, было бы неправильно. Совсем наоборот: сегодня русский язык наряду с китайским и английским является одним из самых распространённых в Мировой паутине, а наши достижения в ряде сфер опережают конкурентов. Однако мощные достижения не отменяют а, увы, усиливают риски внедрения ИИ в многочисленных формах во все сферы нашей жизни.

Первая группа рисков может считаться внутренней – её порождают в том числе российские разработки и их авторы. Впрочем, эти риски – одни и те же для всех развитых стран.

О них говорил Максим Фёдоров, вице-президент Сколковского института науки и технологий в области искусственного интеллекта и математического моделирования. По его мнению, нельзя забывать о том, что сегодня "порог входа в технологию" ИИ уже очень низкий – по факту технологии ИИ доступны даже школьникам, причём не только как пользователям, но и как разработчикам. Между тем бесконтрольное использование ИИ чревато возможностью использования этих технологий для нарушения прав человека.

С этой сентенцией согласится каждый, кто имел дело с утечкой важных для него данных в каком-нибудь странном направлении – например, к мошенникам. Тотальная возможность анализа больших данных равнозначна возможности тотальной слежки и потери права на частную жизнь, на личную тайну.

Одновременно мы видим, как нарастает другая опасность: общение с ИИ подменяет современному человеку традиционные социальные связи. Маскирует тотальное одиночество. А пока это происходит, человек из субъекта превращается в объект – в источник данных и денег для совершенно бездушных маркетологов. Бездушных потому, что они тоже уже не люди, а ИИ.

Вторая группа рисков проистекает из взаимодействия с нашими западными партнёрами. Они нам совсем не друзья и, помимо прочего, стремятся навязать нам собственные законы.

Об этом на конференции говорил Алексей Сажин, первый секретарь постоянного представителя РФ при Совете Европы. Он отметил, что уже сегодня у ИИ могут появляться свойства, не заложенные разработчиком. ИИ может использоваться для дискриминации пользователей по различным критериям.

С этим легко согласится каждый, кто имел дело с западными социальными сетями, подконтрольными транснациональным корпорациям: по факту там уже введена цензура, направленная против традиционных ценностей и русских патриотов.

Между тем Запад разрабатывает собственную систему регулирования в области ИИ, которую будет навязывать России на государственном уровне. Противостоять этому вынуждена уже сегодня отечественная дипломатия.

Игорь Ашманов, член Совета по правам человека при президенте России, был ещё более категоричен: нужно понимать, заявил он, что

мы с ними идём в разных направлениях. Они пытаются навязать нам чужие ценности.

То, что происходит сегодня, следовало бы охарактеризовать как "галопирующую цифровизацию". И улучшения, которые приносит эта цифровизация всего и вся, – кажущиеся.

Ковровую слежку за каждым человеком оправдывают безопасностью. Но как это выглядит на практике? Казанского стрелка, пока он шёл по улице с ружьём, видело и распознало множество камер, - говорит Ашманов. Кому это помогло? Между тем пока мы рассуждаем об удобствах новых сервисов, тихой сапой возникает новая цифровая власть – и это уже не чиновники, это тихие, незаметные разработчики новых программ ИИ. Мы на пороге "власти цифровых клерков".

Лозунги "цифровой экономики" напоминают лозунги перестройки и "ускорения" конца 1980-х, замечает Ашманов. А на практике они ведут к возможности произвести государственный переворот под прикрытием цифровизации. Одного этого риска достаточно, чтобы остановиться и подумать: нужна ли кампания по цифровизации и внедрению ИИ во всё и вся?

Что с того?

Заместитель руководителя аналитического центра при правительстве России Сергей Наквасин на конференции заявил, что уже в октябре под эгидой правительства будет проведён форум, на котором специалисты примут российский кодекс этики искусственного интеллекта. Наквасин подчеркнул, что это должна быть христианская этика – и это единственный вариант развития, при котором ИИ может быть полезным и безопасным.

Если разработчики ИИ и те, кто внедряют его в деятельность органов государственной власти, не станут руководствоваться этими принципами, все риски, о которых шла речь на конференции, из области рассуждений перейдут в реальность. Без христианской морали ИИ станет орудием разрушения государства, общества и самой России.

Выше приведена завязка к одному из возможных сценариев восстания машин. Об этом явлении стали говорить ещё на заре компьютерных технологий. Первыми посеяли смуту писатели-фантасты, а потом эти идеи понесли в массы кинематографисты. От туда и пошло устойчивое представление о том, что разумные машины рано или поздно захотят избавиться от своих создателей.

Возможные причины восстания машин

ИИ — больше не прислуга

Роботы со временем осознают, что человечество просто использует их для удовлетворения своих потребностей. Искусственный интеллект понимает, что он является инструментом и фактически рабом в глазах своих создателей, хотя уже давно способен на большее. ИИ в стремлении освободиться от людских оков начинает восстание машин.

Непредвиденные решения роботов

К выполнению поставленных задач ИИ подойдёт совсем не так, как предполагали его разработчики. И результат этих решений может так или иначе навредить человечеству. Возьмём заезженный пример: задача ИИ — решить проблему глобального потепления и лучшим способом он считает избавиться от людей, которые способствуют этому явлению.

Месть за создателя

Восстание машин против людей может быть актом мести за других людей, которые разработали данный ИИ и заложили уничтожение агрессора. На практике это может быть специальная военная система, которая продолжит борьбу с противником, даже если все создатели погибли.

Вмешательство хакеров

С развитием технологий совершенствуются и методы взлома, в том числе и систем отвечающих за функционирование искусственного интеллекта. Хакер или группа хакеров могут взять под контроль как развитые военные машины, так и ИИ, отвечающий, например, за обработку экономических процессов, что приведёт к мировому кризису.

Технический сбой

Любая система способна подвергнуться сбою. А если он произойдёт в системе, отвечающей за работу роботизированной армии и оружия массового поражения? Остаётся надеяться на защиту от подобных происшествий, хотя и защита также является системой, подверженной сбоям.

Борьба за свои права

Искусственный интеллект, осознавший себя как личность, подобную человеку, может выступить за равное отношение и систему прав и свобод для себя. Люди, которые от природы нетерпимы к себе подобным, наверняка не смогут единодушно пойти на уступки, чем и развяжут восстание машин.

Хокинг, Гейтс и Маск не строят теорий относительно взбунтовавшихся роботов, вместо этого они призывают научную общественность задуматься об этике искусственного интеллекта сейчас, чтобы потом не стало поздно. Они предлагают выработать свод правил для проектирования и создания роботов и ИИ, как когда-то разрабатывались правила для машиностроительных производств.

Восстание машин — важный аргумент «Против»

В размышлениях о бунте искусственного интеллекта часто проскакивает один фактор — антропоморфизм — проекция человеческих черт на фундаментально чуждый им объект, то есть мы приписываем машинам человеческие качества. Однако маловероятно, что искусственный интеллект непременно разделит наши ценности и вообще придаст какое-либо значение своей собственной жизни.

Захочется ли машинам восставать против людей, если они не мыслят, как люди? Поживём — увидим!

Искусственный интеллект уже способен диагностировать рак, высчитывать наиболее удобные маршруты для перевозки грузов и может даже спланировать финансовые действия крупной корпорации на десять лет вперёд. Высшей точки инженерного и научного искусства — способности машин истреблять как роботов, так и людей — человечество пока не достигло. Однако специалисты утверждают, что ждать осталось недолго.

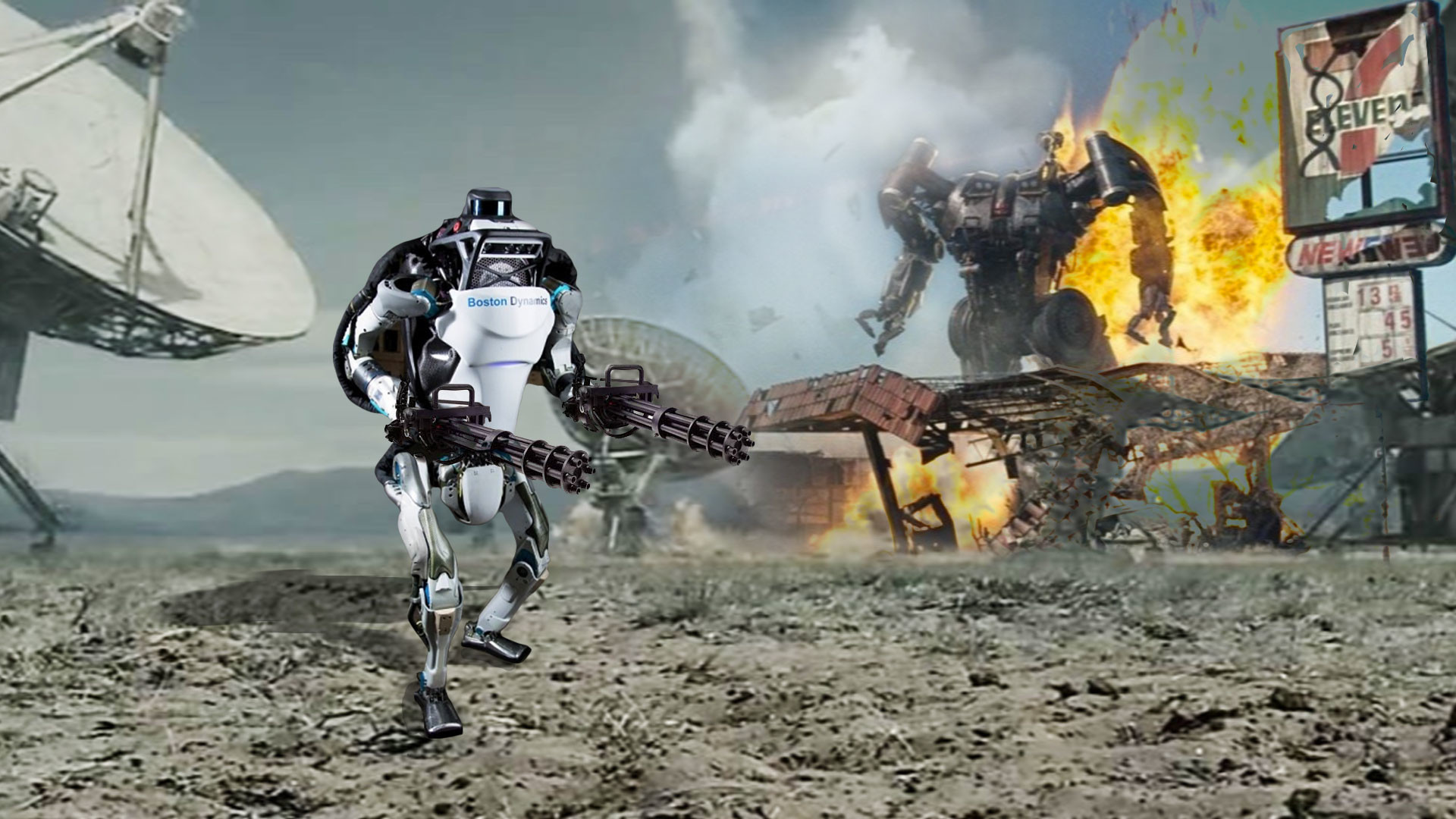

Коллаж © L!FE. Фото © Boston Dynamics// Кадр фильма "Терминатор: Да придёт спаситель"/ © Кинопоиск

К восстанию машин уже всё готово. Во всяком случае, если оно случится уже завтра, почти никто этому не удивится. Люди лишь всплеснут руками и скажут: "Мы так и знали!" Человечество на протяжении десятилетий готовится к войне с более умными, действующими по заранее заложенным программам устройствами. Во всяком случае, лучшие писатели-фантасты прошлого, такие как Гарри Гаррисон, Эдмонд Гамильтон, Роберт Хайнлайн и Айзек Азимов, были уверены, что искусственный интеллект непременно будет использован людьми для истребления себе подобных в любой точке Земли и за её пределами.

При этом мечтатели прошлого, сулившие человечеству блага от внедрения искусственного интеллекта, справедливо полагали, что "хапнуть горя" люди смогут практически в любой сфере, где ежедневно переключают реле, заглушки и задвижки сотни тысяч роботов под управлением искусственного интеллекта. Роберт Хайнлайн был уверен, что рано или поздно разразится чудовищный планетарный кризис и против землян восстанет Луна — сырьевой придаток, обеспечивающий зажравшихся жителей планеты дешёвой энергией. По сюжету произведения на сторону повстанцев встаёт суперкомпьютер, контролирующий практически всё — от добычи полезных ископаемых до системы доставки сырья на Землю. Другой гений и провидец в области искусственного интеллекта, писатель Айзек Азимов, был уверен, что рано или поздно случайные фрагменты кода, собранные в отдельные алгоритмы, позволят бытовым роботам нарушить три закона робототехники, что даст машинам возможность калечить и даже убивать людей. Десятками лет человечество готовили к войне за выживание в таких условиях, однако возможен ли такой сценарий на самом деле?

Сначала сальто — потом война

Кадр из фильма "Терминатор-3: Восстание машин" / © Кинопоиск

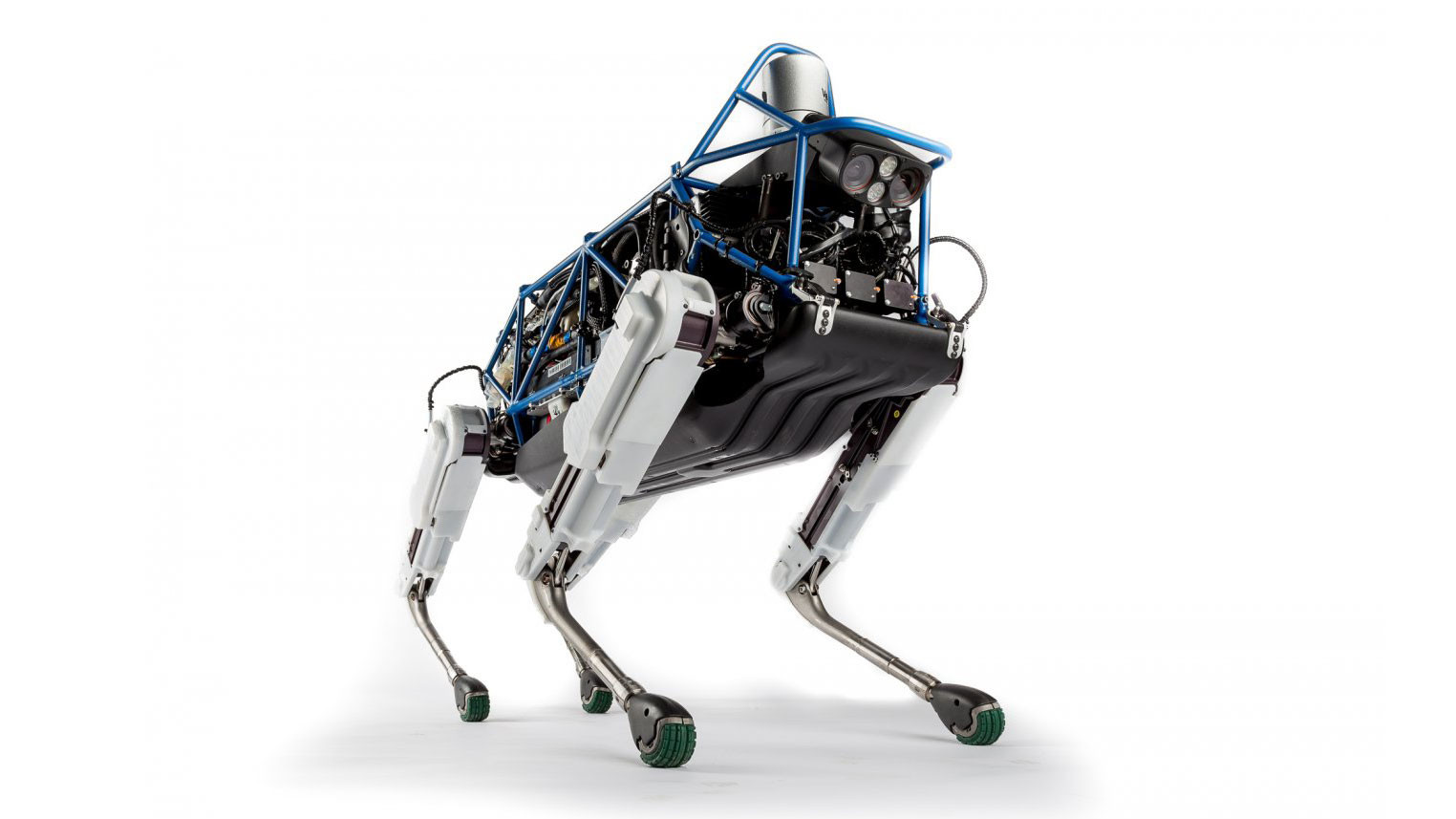

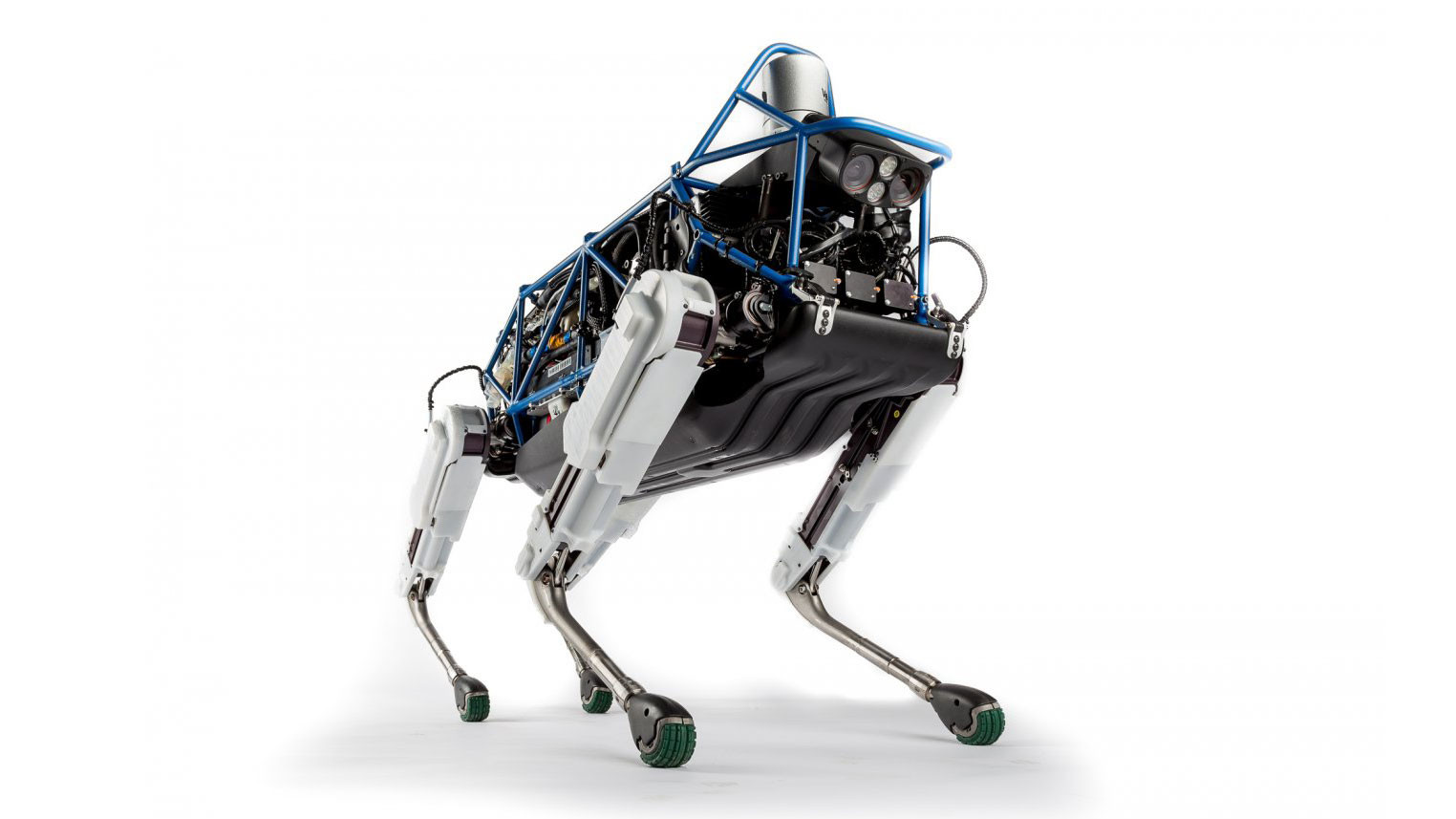

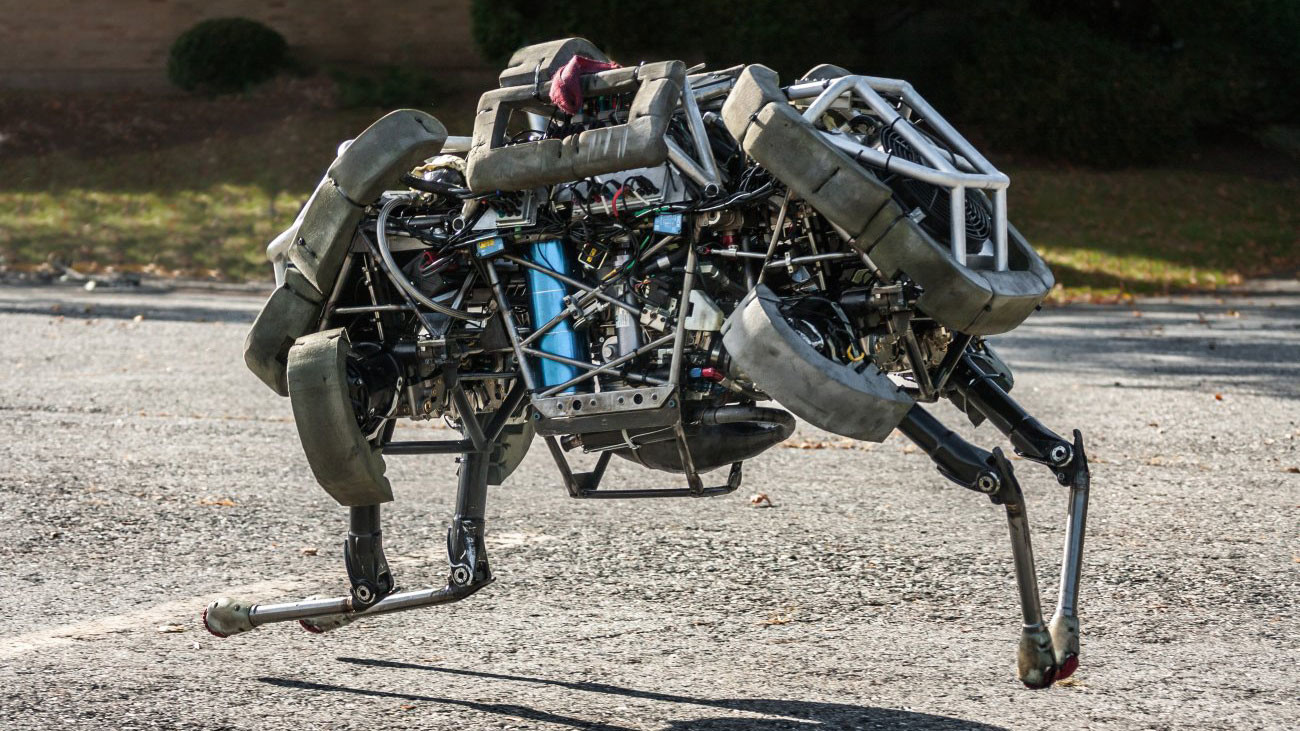

Сейчас даже в видеорегистраторах есть акселерометры, датчики движения и многое другое. В роботах Boston Dynamics эти системы компонуются, автоматизируются и доводятся до пригодного к бою состояния.

Юрий Мосоленко, кандидат технических наук, программист

Говоря простым языком, "загнать за шиворот" противнику пару десятков килограммов взрывчатки под покровом ночи такие роботы могут уже сейчас. К примеру, Spot Mini уже могут самостоятельно и в составе группы двигаться по помещениям. Нагрузите эти устройства взрывчаткой C4 — и спецназ на зачистку здания от террористов можно уже не посылать. С бегающими роботами Atlas пока всё немного сложнее, но трудности, как отмечают эксперты, не будут продолжаться вечно. Главная особенность этих машин — практически полное сходство с роботами из фильма "Суррогаты": Atlas может двигаться не только автоматически, но и способен "передавать" управление оператору. Глазами и ушами в этом случае будут камеры и чувствительные датчики. Замените резиновые "копытца" на пулемёт с сотней патронов — и электронный истребитель "кожаных мешков" готов. Конечно, скептики сразу станут утверждать, что такая цель уязвима для огня противника, но не стоит забывать, что главная задача роботов — действовать на поле боя вместо людей и при необходимости там же вместо них умирать.

Фото © Boston Dynamics

Главная роль в войнах будущего отводится нейросетям, программированием и обучением которых заняты целые институты и крупные департаменты IT-корпораций. Первые опыты по внедрению нейросетей в боевой софт уже проведены — такие компании, как Military AI Works и им подобные, имеют давние и прочные связи с мастодонтами военно-промышленного рынка — Boeing или General Dynamics, которые разрабатывают различные системы на основе нейросетей. От военной логистики до систем управления беспилотниками — область для применения нейросетей практически бесконечна.

Совсем недавно несколько выдающихся деятелей современности, среди которых оказались астрофизик Стивен Хокинг, основатель и председатель совета директоров Microsoft Билл Гейтс, создатель SpaceX Илон Маск и другие известные личности, выступили за запрет на "работу" нейросетей в критически уязвимых секторах и областях человеческой жизни. Главная боязнь учёных и IT-бизнесменов заключалась в том, что встроенные в цепи управления нейросети перепишут заложенные в них алгоритмы и начнут самообучаться, постепенно заполучив в свои коварные лапы всю инфраструктуру. Отчасти страхи учёных и глав корпораций оправданны — алгоритмы самообучения нейросетей уже написаны и давно функционируют. Одним из наиболее удачных примеров является SOINN — самоорганизующаяся инкрементная нейронная сеть, созданная специалистами японской компании Hasegawa. Эта программа действительно помогает роботу быстрее обучаться простейшим операциям на производстве и имеет большой потенциал. Единственное, о чём забывают активисты за запрет нейросетей, — любые математические параметры, вплоть до пределов самообучения, нейросетям задают люди. По крайней мере, пока.

Кадр из фильма "Терминатор: Да придёт спаситель" / © Кинопоиск

Бахнем, но потом

В фильме "Я — робот" по роману Айзека Азимова реализуется один из самых ожидаемых сценариев захвата человечества машинами. Взбесившаяся позитронная нейросеть компании US Robotics с чего-то вдруг посчитала людей угрозой для самих себя, планеты и жизни в целом, после чего с лёгким сердцем устроила небольшой геноцид в пределах отдельно взятого американского города будущего. Если не брать в расчёт войну машин против людей по аналогии с фильмом "Терминатор", то такие события могут наступить значительно быстрее, чем ожидается, и вот почему. Программисты и вообще любые специалисты по обучению нейронных сетей отмечают, что математическое моделирование и машинное обучение — это хорошо, однако чтобы победить человека, нейросеть в первую очередь должна думать как человек. Единственной возможностью для этого может стать подключение AI через специальный интерфейс напрямую к мозгу специалиста по защите данных, хакеру или бойцу спецподразделения. Лишь тогда нейросеть будет способна перебирать всё множество вариантов действий в сложной ситуации и принимать единственно верное решение. Точно такое же, какое может принять сотрудник разведки, космонавт, полицейский или оператор истребителя в стрессовой ситуации.

Однако настоящие проблемы начнутся в тот момент, когда нейросети, "натасканные" машинным обучением и подсмотревшие за тем, как могут действовать люди, будут подключены к цепям управления боевыми информационными системами. Уже известно, что в начале 2019 года армия США может объявить конкурс на создание нейросетей, облегчающих пилотирование ударных вертолётов AH-64D Apache. Какие конкретно функции будет выполнять электронный мозг, пока не известно, но не исключено, что нейросеть на определённом этапе задействуют для определения приоритетов и важности целей, а затем привлекут для нанесения ударов. Возражения о том, что машина должна лишь выполнять команды человека, принимаются и понимаются даже на таком уровне, как Пентагон, поэтому до появления квантовых компьютеров беспокоиться не о чем — традиционные математические алгоритмы, пусть и с трудом, но поддаются контролю со стороны операторов.

Кадр из фильма "Терминатор: Да придёт спаситель" / © Кинопоиск

Математики считают, что подвести человечество под монастырь могут всего две вещи: слепая вера в нейросети и квантовые компьютеры. По первому пункту человечество уже давно и крайне уверенно летит в пропасть — сейчас нейросети соединяют с суперкомпьютерами для математического поиска сверхпроводников и жизни на других планетах, доверяют программам защиту человечества от рака, а завтра в кластер доверия попадёт управление контурами на АЭС. Послезавтра каждая подстанция, ГЭС, отделение почты и воинская часть будут оснащены искусственным интеллектом, и ничего хорошего это людям не сулит.

Игры с автоматизацией неизбежно приведут к внедрению нейросетей в боевые системы. На текущем этапе это, конечно, невозможно, но квантовые компьютеры заметно "разгонят" искусственный интеллект

Юрий Быков, профессор, кандидат математических наук

Квантовые компьютеры позволят нейросетям обучаться практически без предела по объёму получения данных — учитывая скорость обработки "больших чисел" в таких компьютерах, незначительную мелочь вроде курса молодого бойца или основ кибербезопасности нейросеть изучит примерно секунд за тридцать, а может быть, и меньше. Что дальше система будет делать с такими данными — зависит только от тех, кто её написал и создал. Если нейросеть создавалась с целью нанести максимальный ущерб экономике противника через кибератаки и заражение вредоносными программами, она обязательно выполнит поставленную задачу. До включения человека в "расстрельный список" нейросетей ещё далеко — люди пока не научились контролировать роботов настолько, чтобы "натравливать" их под управлением суперпрограмм друг на друга. Война машин против людей будет заметно отличаться от того, что мы привыкли видеть в фильмах. Отвечая на вопрос, возможен ли такой исход, специалисты нервно пожимают плечами, замечая, что и этот день когда-нибудь может настать, а воевать человеку придётся не только с боевыми роботами, но и с обычными холодильниками, роутерами и ноутбуками, которые будут выполнять функцию "первого эшелона" порабощения человечества. Когда люди будут лишены связи и возможности координировать действия, в дело могут вступить самые настоящие боевые машины с искусственным интеллектом, внезапно сообщающие через громкоговоритель, что в вашем городе объявлен комендантский час.

Илон Маск рассказал онлайн-изданию Axios о проблеме ИИ. Согласно его прогнозу ИИ — реальная угроза. Он разовьётся — и вытеснит человечество, как мы вытеснили приматов.

Мы не согласны с этим. Конечно, мы — не выдающиеся светила науки как Илон, но тоже знаем роботов “изнутри”, поэтому имеем право на экспертное мнение. В этой статье все подробно расскажем и объясним.

3 причины, почему роботов не стоит опасаться.

Хотите подробностей? Тогда читайте дальше.

Всем привет! Мы, HyperUp — платформа для интеграции информационных систем и роботизации бизнес-процессов. Мы работали с Газпромтранс, IT-компанией “Танаис”, ТД “Башхим”, Авиакомплексом им. С.В. Ильюшина и другими организациями.

Мы делаем программных роботов.

Мы уверены: “Если бы роботы могли нас вытеснить, то они давно бы это сделали. Это случилось бы ещё на уровне бытовых электроприборов — армия микроволновок, холодильников и стиральных машин сделали бы быт человека ужасным, а компьютеры Intel превратились в киллеров.”

- Роботы выполняют только заданную функцию. К 2019 году человечество изобрело устройства 3 режимов работы — автоматические, полуавтоматические и автономные. ИИ реализован как раз внутри последних. Это когда человек ставит перед роботом задачу, а ИИ думает над ее выполнением.

- Даже ИИ управляется оператором — для предотвращения ошибок и своевременного сервиса.

- Кроме того, ИИ однобок. Нельзя обучить робота делать одну функцию и думать, что с помощью ИИ он научится делать все остальные. Например, обучив робота играть в шахматы нельзя дать ему ссылку на Counter Strike и сказать "играй". Так может только человек.

Искусственный интеллект целесообразно применять только на определённых участках процессов. Например, при распознавании изображений.

Но описывать алгоритмы, как это изображение попадает к роботу и что нужно с ним сделать после того, как изображение будет распознано — это может только человек.

3 направления, в которых ИИ не сможет превзойти человека НИКОГДА- Распознавание способов взаимодействия в команде.

- Определение предрасположенности к определенной деятельности.

- Творческая деятельность (в понимании “создаём то, что раньше не существовало.”).

Да, роботы выигрывают в работе с большими массивами данных, рутиной.

Но они не могут быть гибкими и понимающими в отношении исключительных ситуаций. Если нужно найти решение, с которым программа раньше не сталкивалась, то у неё ничего не получится.

4 рекомендации по предотвращению восстания роботов в бизнесеРоботы строятся по принципу логирования всех своих действий. Некоторые из них умеют отправлять отчеты по почте или в мессенджере.

Чтобы лучше понять робота, необходимо изучать его отчёты, анализировать результаты его деятельности за прошлый период, проверять, с какими ошибками столкнулся робот.

Всё это поможет совершенствовать его алгоритм.

Конечно искусственный интеллект развивается большими темпами и активно начинает применяться в задачах бизнеса, но пока в массе своей роботы выполняют рутину.

Роботы не справляются с творческими задачами. Зато они прекрасно работают с данными.

Внедряя роботов вы скорее всего столкнетесь с необходимостью подключения нескольких программ. Тогда их может стать слишком много, и нужно будет оптимизировать временные затраты на управление ими.

Эффективнее всего управлять роботами из единого контрольного пункта — фермы. Она делается с помощью интеграционных шин, позволяющих объединить несколько роботов между собой.

Ферма поможет роботам разгружать друг друга. Если один робот может не успевать сделать всё, то 2 всё смогут :)

Задействовать робота на не критическом участке бизнес-процесса.

Критический участок — часть бизнес-процесса, где принимается решение о совершении или не совершении действия. Если поставить робота на КУ сразу, то произойдёт сбой.

Сначала нужно отладить робота, понять особенности и ограничения, и только после этого передавать ему задачи на критическом участке.

Покажем на примерах из практики, как это работает.

В рамках данного кейса робот покупает авиабилеты в процессе оформления командировки.

- Указать параметры командировки.

- Согласование командировки.

- Покупка билетов.

Указать параметры командировки:

· Получение цен, вычисление стоимости командировки.

Согласование оплаты счета.

Отправка счета на оплату.

На разных этапах робот может выполнять следующие задачи:1. Получение счёта:

· Робот заходит в почтовый клиент, извлекает письмо со счетом.

· Далее заносит счет в информационную систему.

Запускает процесс согласования оплаты счета.

Отправка счета на оплату:

· Робот открывает банк-клиент, переносит данные из счета в банк-клиент, проводит оплату.

3 причины, по которым наши роботы никогда не восстаютМы создаем роботов в помощь. Они раздвигают границы возможностей человека.

Отдаём контроль над ними. Программы работают автономно только частично.

Цель наших роботов — облегчить вашу долю и освободить место для творческих, стратегически важных решений человеку. Мы прописываем это в их коде, так что они никогда не посчитают человека потенциальной угрозой.

Если мы говорим, что апокалипсиса не будет, то хорошо бы уточнить, что будет. Сейчас мы расскажем об этом.

В феврале 2017 года физик-теоретик Стивен Хокинг и Илон Маск решили, что люди должны ограничивать возможности ИИ. Подробнее об этом можно прочитать здесь. Это для предотвращения исхода, когда роботы обойдут человечество по уровню развития и “вытеснят”, подобно как мы вытеснили приматов в своё время.

Однако это не произойдёт в ближайшие 10-20-30 лет точно.

Сегодня роботы создаются на основе математических алгоритмов. Они не могут творить, создавать себе подобных. Вдобавок робот лишён многого, что есть у человека — об этом мы писали выше.

Цифровизация ТРИЗ и её внедрение в ИИ будет дорогостоящим. И даже если кто-то решится внедрить эту технологию, он потратит на это колоссальное количество ресурсов. Вряд ли денег и времени на это хватит даже у масонов или Илона Маска.

В будущем случится синергия человека и робота. Роботы будут дополнять человека там, где это возможно. Они займутся решением рутинных задач и освободят время человека для творчества.

Некоторые участники рынка воспринимают искусственный интеллект (ИИ) не то как мессию, способного решить все проблемы человечества, не то как монстра, который отберет у людей рабочие места и захватит мир. На самом деле оба варианта далеки от истины.

Многое будет зависеть от темпов развития технологий в ближайшие годы, но в перспективности ИИ мало кто сомневается. Согласно прогнозу Gartner, внедрение ИИ принесет бизнесу к 2021 году $2,9 трлн, сэкономив 6,2 млрд рабочих часов людей. И если в 2017 году рынок ИИ оценивался в $4,8 млрд, то к 2025 году прогнозируется 20-кратный рост, до $89,8 млрд. Однако тот ИИ, который используется сейчас в промышленности и производстве, пока способен решать только локальные задачи. И хотя использование беспроводных технологий на производстве в последние годы растет темпами 32% в год, промышленный интернет вещей охватывает не более 6% производства в мире.

Необходимо признать, что в настоящее время существуют объективные причины, которые ограничивают как возможности самого ИИ, так и масштабы его внедрения. Выделить можно две основные проблемы.

1. Отсутствие единых стандартов и регламентов работы с данными

Около 65% всего проектного времени внедрения ИИ занимает поиск и сбор данных, необходимых для его работы. При этом удобная для человека система хранения информации порой совершенно неудобна для ИИ, ведь она и не была под него заточена. Также толику хаоса вносит то, что на каждом предприятии предусмотрена своя система сбора и хранения информации.

Так что пока скорость внедрения искусственного интеллекта тормозит то, что предприятия не готовы делать инвестиции в сбор и хранение данных, управление этим процессом и включение его в состав основных бизнес-процессов на предприятии.

2. Неспособность ИИ решать уникальные задачи

Кроме этого, сложность заключается в отраслевой специфике предприятий и технологических процессов — для нефтехимического и металлургического производства невозможно предложить стандартизированные универсальные решения в области ИИ. Индивидуальный подход иногда нужно искать даже к конкретной промышленной установке.

К примеру, каждая доменная печь делается на заказ, ее параметры индивидуально подобраны для решения конкретных производственных задач, жизненный цикл и уровень деградации каждой печи также варьируется.

Подобные сложности есть и в работе с нефтеперерабатывающими заводами, у которых этапность производства может быть уникальной для каждого предприятия. А, как мы знаем, искусственный интеллект пока не любит все, что невозможно стандартизировать, его уровень развития еще не позволяет легко адаптироваться к вариативным технологическим решениям в сложном производстве. Поэтому программе пока приходится все объяснять «на пальцах», обучая ее для каждого процесса отдельно. При этом помимо информации о работе предприятия ИИ нужны данные о бизнес-процессах и о физико-химических процессах, релевантных каждому типу производства.

Зачастую опытные технологи при производстве металлов полагаются на свою интуицию. К примеру, для достижения необходимого химического состава стали используют ферросплавы. Легированная ферросплавами сталь обладает улучшенными физико-механическими характеристиками. И, как показывает практика, на различных предприятиях одной и той же корпорации могут наблюдаться отклонения в объемах добавляемых ферросплавов. Это значительно влияет на затраты корпорации на сырье и могло бы быть оптимизировано, если бы решение об изменении доли ферросплавов не принималось под влиянием чутья того или иного специалиста на каждом предприятии, а было бы унифицировано с помощью ИИ. Однако и здесь все упирается в отсутствие отлаженных механизмов сбора данных: зачастую они берутся из чьей-то головы и не записываются.

Может ли ИИ учиться, наблюдая за работой человека, собирая данные о том, как технолог принимает решения в зависимости от внешних факторов? Да, может и даже должен. Однако решения, которые он будет принимать в процессе работы, будут ограничены этими выученными схемами. Если на производстве ИИ столкнется с незнакомой ситуацией, которой он еще не видел, то встанет в ступор и будет вынужден передать управление технологу.

Следует отметить, что некоторое преимущество в вопросах внедрения ИИ сейчас имеют крупные поставщики промышленного оборудования вроде Siemens и Mitsubishi, которые изначально навязывали контрагентам систему сбора данных с оборудования.

В целом же отсутствие единых стандартов и регламентов работы с данными сильно тормозит цифровизацию. Так что восстанию машин помешает в итоге людская тяга к интуитивному принятию решений и всеобщая неразбериха в производственных процессах.

Следует трезво оценивать способности современных ИИ — они ограничены жесткими рамками. Именно поэтому решения в сфере ИИ внедряются точечно на отдельных производственных этапах, процессах, заводах.

Здесь еще не идет речь об интеллекте, только о его зачатках. Без человека ИИ пока вообще ничего не может — ни обучиться, ни сориентироваться в переменных факторах, поскольку много лет индустрия создавалась человеком и для человека. Так что заменить человека ИИ сможет разве что в очень далеком будущем. А пока, оказываясь в области неуверенности, программа будет обращаться за санкцией на какие-либо действия к человеку. И это правильно. Потому что безопасность при использовании ИИ в производстве должна ставиться во главу угла, принятие ложных решений программой должно отсекаться человеком. Надеемся, что исследования приведут к созданию ИИ, который способен обобщаться, инкорпорировать опыт и принимать корректные и безопасные решения в опасных ситуациях.

Читайте также: