Медленная матрица монитора как исправить

Покупал Asus VX248H.

На момент выхода он стоил около 400$ в украине.

Прошло с тех пор около 3-х лет и теперь нижняя часть монитора тормозит примерно на 0.3-0.5 секунд в зависимости от резкости движения, из-за чего изображение искажено.

Хорошо заметно при просмотре фильмов где кадр идет из стороны в сторону, нижняя часть экрана разделяеться мерцающей линией. В играх ето все же отвлекает, линяя рябит. Что скорее всего еще и портит зрение. При статичной картинке, к примеру написания кода, скролл, это незаметно.

Подозреваю что дело в TN матрице или где-то в цепях, возможно где-что подгорело из-за перепадов напряжения.

У меня есть еще один жк монитор Philips 248C3LHSB, покупался лет 5-6 назад и работает нормально, хотя яркость поубавилась.

Стоит ли тратить время и нести в ремонт или купить новый?

Как часто вы меняете мониторы?

Как часто ремонтируете?

Были ли похожие случаи?

Если покупать новый, какой бренд?

Исходя из инфы в инете, жк моник работает от 5+ лет в худшем случае, выходит что Asus не такой уж и "гейминг".

У меня использование монитора около 15 часов в сутки, минмальный срок службы 30 000 часов, 30 000 / 15 / 360, любой жк монитор который отработал менее 5.5 лет, не стоит своих денег.

Lenovo вообще треш, подобрать монитор на свалке и он работать лучше и дольше будет.

Присматриваюсь в случае чего в Dell и HP.

- Вопрос задан более года назад

- 72 просмотра

Похоже не проблемы с вертикальной синхронизацией.

Попробуйте поиграться с частотами монитора в настройках видеоадаптера. Может достаточно переключить с 59Гц на 60Гц или наоборот. Если это только в фильмах, смените видеоплеер, может он некорректно vsync использует.

В остальном - тратить Вы будете не силы, а деньги. Если сервис скажет, что проблема устранима, то вопрос лишь в цене, ведь зачем тратить больше на новый?

Это не проблемы с софтом или какой-то синхронизацией. Это дохлая матрица. А точнее, пропадание одного из напряжений (или проседание) после одного из дешифраторов матрицы. В ряде случаев лечится подпайкой тонкого проводочка в другую точку, с тем же напряжением. Но это довольно узкоспециализированная неисправность, даже с опытом сложно будет найти как устранить. А может быть и вовсе не получиться устранить.

Ок, отвечу и на другие вопросы

- в среднем раз в два-три года покупаю один новый (у меня мониторов пять на одном ПК)

- БП через пять лет сдыхают, ремонтирую сам или меняю БП

- у меня такого ни разу небыло за 20 лет. Если проблемы с матрицей - на выброс, ремонт обычно не целесообразен

- разные покупаю, у одного LG было матрица сдохла, а БП дохнут у всех, рано или поздно

В этой статье рассмотрим проблему задержки отображения мониторов.

реклама

Мониторы являются одними из важнейших составляющих компьютера, которые вносят весомый вклад в общее время задержки (кадров изображения) всего компьютера, от начала формирования кадров в центральном процессоре, до отображения их на экране монитора. Кроме того, монитор часто является источником дополнительных фризов.

В прошлой моей статье: высокие задержки DPC в видеокартах NVIDIA GTX 10-х серий и метод решения этой проблемы, один из комментаторов справедливо заметил, что при выяснении причин фризов и высоких задержек компьютера, не было учтено влияние мониторов на эти негативные факторы. И не раскрыт вопрос, какое влияние на задержки отображения мониторов и вносимые ими фризы оказывают "скалеры" входящие в состав мониторов.

Итак, кратко напомню, из чего состоит монитор:

реклама

var firedYa28 = false; window.addEventListener('load', () => < if(navigator.userAgent.indexOf("Chrome-Lighthouse") < window.yaContextCb.push(()=>< Ya.Context.AdvManager.render(< renderTo: 'yandex_rtb_R-A-630193-28', blockId: 'R-A-630193-28' >) >) >, 3000); > > >);По вопросу задержки отображения, нас в этой схеме интересуют только два структурных узла: скалер, через который проходит сигнал изображения, и ЖК матрица, которая отображает это изображение на экране.

Для чего нужен скалер?

Скалер необходим для масштабирования изображения, то есть для преобразования, подающегося на монитор «неродного для матрицы» разрешения изображения в необходимое разрешение для матрицы. Например, матрица монитора имеет разрешение 2560x1440, на вход монитора подается изображение с разрешением 1920x1080, или любым другим, отличным от разрешения матрицы. Скалер при этом преобразует это разрешение изображения до необходимого для матрицы, в 2560x1440. Если это «неродное» изображение подать без преобразования сразу на матрицу, то она его не отобразит, она может, лишь отображать изображение, разрешение которого соответствует разрешению матрицы. Так же скалер кроме масштабирования, меняет яркость, контрастность изображения, производит различные улучшения изображения. То есть скалер делает монитор универсальным в плане «переваривания» всех разрешений изображений подающихся на него, и является многофункциональным устройством, которое выполняет сложную обработку изображения. Но! Здесь важно знать, что любая обработка изображений неизбежно приводит к увеличению времени задержки, и чем сложнее алгоритмы обработки, и чем менее производителен применяющийся в скалере процессор, тем будет больше время задержки, и бОльшая вероятность возникновения фризов. Из-за того, что слабый процессор не будет успевать обрабатывать поступающие на него кадры, и начнет некоторые из них пропускать. Самая большая задержка происходит, если на монитор подается «неродное» разрешение изображение и скалер производит пересчет точек этих «неродных» разрешений в необходимое для матрицы разрешение. В некоторых мониторах эта задержка отображения достигает больших значений.

реклама

Как можно минимизировать эту задержку отображения? Самым простым методом этого можно добиться путем выбора монитора с минимальной задержкой отображения, например, выбрать монитор без скалера. Приведу на своем примере, по какому принципу, я выбирал монитор с минимальной задержкой отображения. Выбирая монитор, я знал об этих особенностях скалеров, поэтому и было принято решение найти монитор без скалера. И таких мониторов очень мало. Но мне через некоторое время поисков все, же удалось найти корейский монитор Crossover 2735AMG, в котором скалера нет.

Этот монитор имеет разрешение в 2560х1440 точек. Ну и, конечно же, он может отображать только это разрешение изображения. Если на него подать любое другое разрешение изображения отличное от 2560х1440 точек, то он ничего не «покажет». Например, если подключить его к интегрированной графике, которая имеет разрешение изображения 1920x1080, то он ничего и не «покажет». Поэтому его нужно подключать к видеокарте, сейчас все современные видеокарты, да и все видеокарты, которые моложе десятилетней давности, имеют функцию масштабирования, и сами автоматически отмасштабируют разрешение необходимое для этого монитора. Поэтому этот недостаток монитора я недостатком и не считаю. Но! Зато у него по сравнению с мониторами, имеющими скалер, во много раз меньше задержка отображения.

Другая, старшая модель монитора этой линейки Crossover 2763AMG, уже имеет в своем составе полноценный скалер, и плюс в задержке отображения. По данным различных источников задержка отображения (Display lag) в них уже составляет 20 – 22 мс., а это уже больше, чем период обновления кадров, при частоте кадров в 60 Гц., который составляет 16,7 мс. То есть на монитор уже поступает второй кадр, а на экране только, только начинает отрисовываться первый кадр.

реклама

Здесь важно понимать, что время задержки отображения монитора (Display lag) состоит из времени отклика пикселей матрицы и времени задержки скалера. И что характерно, все производители мониторов не указывают общее время задержки отображения, а указывают только время отклика пикселей матрицы, которые имеют небольшие значения.

Опять все та же политика, выдать потребителю приукрашенные, недостоверные технические характеристики. Опять обман.

К сожалению, измерить задержку отображения без специальной аппаратуры не представляется возможным. Ее еще можно измерить косвенно, путем измерения разницы времени отображения между эталонным монитором и испытуемым монитором. В качестве эталонного монитора можно взять ЭЛТ монитор, где в силу технологических решений в этом мониторе, нет технической возможности для запоминания изображения для его обработки, и поэтому время задержки отображения в таких мониторах очень мало. Или другой монитор, специально предназначенный для этих целей, с минимальной задержкой отображения.

Целью этой статьи я не ставил вычисление и определение точных задержек отображения мониторов, ибо нет специализированной аппаратуры. Но ставил целью, доведение этой проблемы до пользователей, которые об этом не знали. И об освещении вопроса об очередном утаивании производителями мониторов неугодных им, нелицеприятных технических характеристик мониторов.

Надеюсь, моя статья была вам интересна. Пишите в комментариях, сталкивались ли вы с проявлением больших задержек отображения ваших мониторов.

Про то, что можно разогнать процессор, видеокарту или ОЗУ, слышали, я думаю, большинство пользователей ПК. Однако про то, что можно разогнать еще и монитор, знают немногие, причем зачастую разница от его разгона существеннее и заметнее, чем от разгона другого железа. Также она еще и безопаснее, но об этом ниже.

Теория

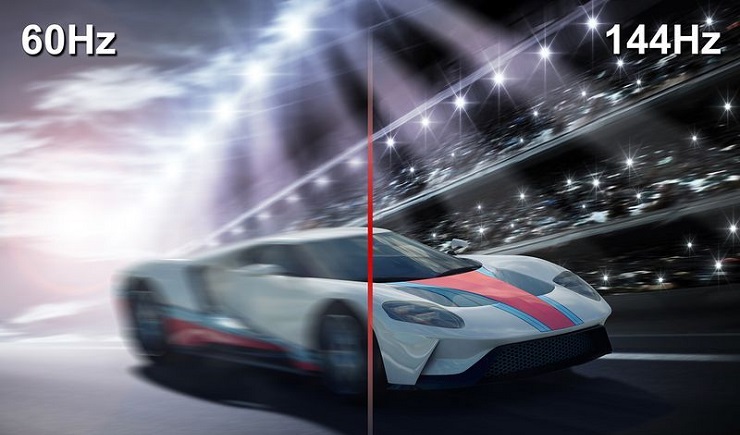

Для начала — что же подразумевается под разгоном матрицы монитора? Подразумевается увеличение частоты обновления монитора со стандартных 60 Гц и на сколько получится — 70-75, бывает и 120, и даже 150 Гц (!). Зачем это нужно? Чтобы повысить плавность картинки. Что означает, что частота обновления монитора — 60 Гц? Это означает, что картинка на экране меняется ровно 60 раз в секунду. При этом видеокарта может выдавать как меньшее количество fps, так и большее. Если количество кадров, выдаваемых видеокартой, меньше частоты обновления, то, значит, какой-то кадр будет дважды (а то и трижды) выведен на экран, что может привести к ощутимым задержкам. Если же количество кадров, выдаваемых видеокартой, больше частоты обновления монитора, то получится так, что на экран будет выдаваться сразу два-три кадра, что приведет к артефактам:

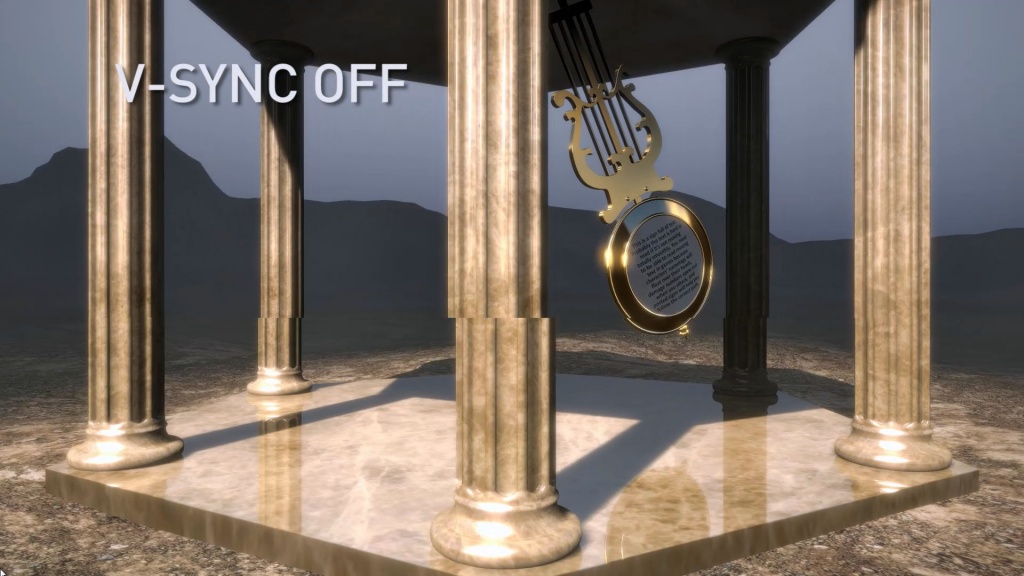

Компромиссом является установка вертикальной синхронизации. В чем ее суть? Она жестко привязывает один кадр, подготовленный видеокартой, к одному обновлению картинки на мониторе. И тут, если ваша видеокарта выдает стабильно больше кадров, чем частота обновления монитора, то вы получите идеальную плавную картинку, ну а ваша видеокарта при этом временами не будет загружена на 100% и будет отдыхать. И именно такой режим работы зачастую используется в системе — к примеру, когда вы скроллите в браузере, артефактов вы не видите, и при этом скроллинг плавный.

Поднятие частоты обновления монитора убивает сразу двух зайцев: во-первых, теперь вертикальная синхронизация будет идти на более высокой частоте, а значит плавность еще повысится (думаю, все видели разницу в роликах на YouTube с 30 и 60 кадрами? Вот тут также). Во-вторых, если ваша видеокарта в играх выдавала больше 60 кадров в секунду, то теперь порог появления артефактов отодвигается до новой частоты обновления, при этом информация на экране будет обновляться чаще, что достаточно важно для динамических игр.

Разумеется, возникает вопрос — насколько это безопасно? Гораздо безопаснее разгона железа: если монитор не может работать на заданной частоте, он просто не включится. Если на заданной частоте он заработал — значит, никаких проблем у вас не будет. Перегрев ему, как в случае с разгоном процессора или видеокарты, точно не грозит.

Практика

Теперь, когда немного разобрались с теорией, можно перейти к практике. Первое, что нужно знать — гонится любой монитор и даже матрицы ноутбуков, но тут есть сразу несколько сдерживающих факторов. Первый — это способ подключения: через DVI при разрешении 1920x1080 вы вряд ли получите свыше 65 Гц — сказывается достаточно низкая пропускная способность интерфейса. Через старые HDMI (до 1.4) при том же разрешении вы скорее всего сможете получить частоту около 75-85 Гц. Ну а через новые HDMI (1.4-2.0), Thunderbolt или DisplayPort ограничений практически нет — можно и 120-165 Гц получить. Аналогично зачастую нет ограничения у матриц ноутбуков, подключенных напрямую к плате. Второй сдерживающий фактор — сама матрица, вернее ее контроллер. Бывает, что даже с быстрым подключением при повышении частоты появляются некоторые артефакты изображения — увы, тут уже ничего не сделаешь, кроме как снижать частоту до последней стабильной.

Теперь поговорим о том, как разгонять. Владельцам видеокарт от Nvidia тут везет — для них алгоритм прост: нужно зайти в панель управления Nvidia, перейти на вкладку «Изменение разрешения», нажать на кнопку «Настройка», в открывшемся окне поставить галку на включении режимов, не поддерживаемых дисплеем, после чего нажать на кнопку «Создать собственное разрешение», и в открывшемся окне мы наконец-то получаем доступ к изменению частоты обновления:

Частоту стоит поднимать на 3-5 Гц, после чего нажимать на кнопку «Тест». Если никаких артефактов не появилось и изображение есть — поднимаете частоту еще выше. Как только появились артефакты или исчезло изображение — снижаете до предыдущей рабочей частоты, и дальше поднимаете уже по 1 Гц — в общем, тут все ровно как при обычном разгоне видеокарты. После того, как нашли нужную частоту обновления, просто сохраняете полученную конфигурацию, и она появится в пользовательских разрешениях.

Как видите, тут риска никакого — если монитор «не завелся» на указанной вами частоте, через 20 секунд система откатит значение частоты на дефолтное. Увы — все так хорошо только с видеокартами от Nvidia, с видеокартами от AMD или Intel все хуже — там в настройках драйвера частоту увеличить нельзя, однако есть универсальное приложение, которое поможет это сделать — называется оно Custom Resolution Utility (CRU), скачать его последнюю версию можно тут.

Сразу предупрежу — проблема программы в том, что у нее нет кнопки Тест, как в случае с Nvidia, поэтому частоты применяются сразу и бесповоротно. Так что если после выставления частоты вы видите черный экран — вам поможет или подключение второго монитора и возврат настроек на дефолтные, или же заход через безопасный режим и проделывание того же самого.

Работать с программой достаточно просто — вы ее запускаете, удаляете все разрешения из стандартных и снимаем все галочки слева (у себя я этого проделывать не буду, ибо уже разогнал матрицу через настройки Nvidia):

Теперь под окном с Detailed resolutions нажимаем на кнопку Add, выставляем Automatic - LCD Reduced и ниже меняем частоту обновления:

Тут принцип тот же — увеличиваем частоту на 3-5 Гц, нажимаем ОК, все сохраняем и перезагружаемся. Теперь заходим в панель AMD (или Intel) и выставляем новую частоту:

Вот, в общем-то, и все — как видите, ничего трудного или опасного нет.

Ну и остается последний вопрос — раз разгоняются почти все матрицы, то почему этого не делают производители с завода? Тут все просто: есть такое понятие, как стандарт, и для частоты обновления мониторов он уже достаточно давно составляет 60 Гц. Поэтому производители, даже если матрица способна работать на 70-80 Гц, все равно ограничивают ее частоту на стандартных 60 Гц. Во-вторых — зачастую все упирается уже в способ подключения. К примеру, передать 1080р60 можно по любому интерфейсу, хоть DVI, хоть Thunderbolt 3. А вот для 1080р80 уже нужен специальный кабель — DVI и старые HDMI уже не подходят. И чтобы не создавать путаницу, производители опять же ограничились 60 герцами.

Что касается вопроса, разгонять или не разгонять — решать вам и только вам. Если у вас получилось увеличить частоту с 60 до 65 Гц — то смысла в таком разгоне нет, разницу вы не увидите. А вот при разгоне уже до 75 и выше Гц разница становится явно видной, так что игра тут стоит свеч. Также следует учитывать, что после разгона повысится нагрузка на видеокарту при обычной работе — ведь ей теперь придется выдавать больше кадров в секунду, так что если вы разгоняете матрицу на ноутбуке — следует учитывать, что у вас несколько снизится время автономной работы.

Нужно ли калибровать монитор? Кто-то скажет: «Конечно, да!» Другой возразит: «Зачем тратить деньги и время, если и так все хорошо?» И оба будут по-своему правы. Сегодня мы рассмотрим различные виды калибровки и узнаем, зачем она нужна и как пользоваться калибратором.

Кому и зачем нужна калибровка

В первую очередь калибровка нужна профессионалам, работающим с цветом. Это могут быть фотографы, дизайнеры, видеографы, полиграфисты и т. п.

Главная цель — правильное отображение цветов на мониторе. Чтобы другие пользователи смогли увидеть именно то, что хотел показать автор, устройство должно быть откалибровано.

Во-вторых, если камера, монитор и принтер профессионального фотографа откалиброваны и имеют одинаковый цветовой профиль, при итоговой печати на бумаге будут получены именно те цвета, которые были в видоискателе и на экране.

В-третьих, калибровка позволяет привести все дисплеи пользователя к единой цветовой настройке. Рабочий экран дизайнера и фотографа должен соответствовать их домашнему собрату и/или ноутбуку.

Обратите внимание: даже после калибровки картинка на двух устройствах может немного различаться ввиду индивидуальных особенностей матриц.

В-четвертых, с помощью данной процедуры можно нивелировать изменения, которые произошли со временем. С годами все мониторы теряют яркость и получают небольшие цветовые сдвиги.

Желаемые итоги калибровки:

- оптимальное отображение цветов;

- отсутствие цветовых сдвигов;

- максимально возможная детализация в темных и светлых областях.

Вопрос: Все ли мониторы можно откалибровать?

Ответ: Откалибровать можно любой монитор, однако смысл такого действия, например, с TN-устройством с цветовым охватом 70 % sRGB, небольшой. До идеальной цветопередачи такие дисплеи довести невозможно.

Некоторые считают, что калибровать мониторы не нужно, потому что эту процедуру они проходят еще на заводе. Действительно, в большинстве случаев для обычного домашнего дисплея вполне достаточно калибровки от производителя.

Калибруем «на глаз»

Каждый человек воспринимает цвета по-разному и видит свой набор оттенков, поэтому калибровка без использования специального оборудования — это скорее процедура для «приведения в чувство» яркости, контрастности и гаммы монитора. Не более того.

Обычно пользователи не любят заходить в настройки монитора, опасаясь что-нибудь испортить. Бояться экспериментов не стоит — всегда можно вернуться к заводским установкам. Как минимум, нужно постараться сделать монитор комфортным для зрения.

Для калибровки «на глаз» существует множество различных сайтов и программ. С помощью предлагаемых тестовых изображений можно отрегулировать настройки монитора, значительно повысив качество картинки, но полноценной калибровкой это назвать нельзя.

На некоторых интернет-ресурсах, посвященных калибровке, можно увидеть следующее.

Но редко, кто указывает, что масштабирование ОС и браузера должны составлять при этом строго 100 %. И владельцы 2К- и 4К-мониторов часто хватаются за голову и начинают пытаться калибровать монитор, хотя по факту не так все и страшно.

Мы же в этой главе пойдем по самому простому пути — «откалибруем» монитор через встроенную утилиту операционной системы Windows 10. Для этого в «Поиске» вбиваем слово «калибровка» и следуем пошаговой инструкции.

Шаг первый — настройка гаммы.

Шаг второй — настройка яркости.

Шаг третий — настройка контраста.

Шаг четвертый — настройка цветового баланса.

Поздравляем, калибровка произведена!

При должной усидчивости и терпении результат будет неплох. Есть одна загвоздка — такая настройка напрямую зависит от особенностей зрения калибровщика и условий внешнего освещения. Соответствует ли теперь монитор всем требованиям для работы с изображениями? Разумеется, нет!

Калибруем монитор с помощью прибора

Чтобы откалибровать монитор, проще всего вызвать специалиста на дом. Стоимость услуги зависит от региона, профессионализма мастера, вида используемого оборудования и может составлять от 500 до 3500 рублей.

Калибратор — устройство для настройки правильной цветопередачи монитора. Представляет собой программно-аппаратный комплекс, состоящий из датчика измерения цвета и специального ПО. Программа отображает на дисплее набор цветов с известными значениями, а прибор измеряет полученное изображение. Затем софт сравнивает эталонные цвета с показаниями датчика и вносит изменения в LUT видеокарты.

Look-Up Table (или просто LUT) — справочная таблица, которая используется монитором в качестве эталона. Сигнал от ПК соотносится с таблицей и выводится видеокартой на экран. В обычной LUT цветовые значения (или координаты R, G, B) сведены в три одномерные справочные таблицы (отдельно для каждого канала R, G и B). Высокоразрядная 3D-LUT — это одна трехмерная таблица, которая включает в себя все цветовые координаты сразу.

Многие фотографы и дизайнеры рано или поздно задумываются о покупке собственного калибратора. И тут начинаются муки выбора. Рынок потребительских приборов сегодня делят два производителя: Datacolor и X-Rite (Pantone). Каждый из них работает в этой сфере много лет и успел выпустить несколько поколений калибраторов, из чего можно сделать вывод, что ребята знают, чем занимаются. Несмотря на минимальные расхождения в результатах, священные войны между поклонниками обеих марок на просторах интернета идут не прекращаясь.

Базовые модели калибраторов доступны по цене от 150 долларов, просты и быстры в использовании. Зачастую вся процедура отнимает всего 15-20 минут, не считая предварительного получасового прогрева матрицы.

Дорогие калибраторы имеют больше возможностей и позволяют дополнительно калибровать телевизоры, проекторы, смартфоны. Автор подозревает, что калибраторы одной линейки полностью идентичны по начинке, а деньги с нас дерут именно за специализированное ПО, поэтому для простой калибровки монитора достаточно иметь самый бюджетный вариант.

Перед процедурой калибровки нужно провести несложную подготовку:

- Расположить дисплей на планируемом месте работы.

- Убрать от монитора направленные источники света. Калибровку лучше проводить при том же освещении, при котором обычно работает пользователь. Если требуется использовать монитор и при искусственном, и при естественном освещении, можно сделать несколько цветовых профилей.

- Прогреть монитор минимум 30 минут.

- Установить родное разрешение монитора и нейтральное фоновое изображение в серых тонах на рабочий стол.

Давайте рассмотрим, как проходит процедура калибровки на примере Datacolor SpyderX Pro, который относится к последнему поколению приборов компании. Софт для калибратора скачивается только на официальном сайте и активируется комплектным ключом. ПО SpyderXPro 5.6 отлично русифицировано, каждое действие снабжено подробными комментариями. Первая страница предлагает провести подготовку.

Далее выбираем тип дисплея.

После этого программа предлагает ввести название производителя и модель монитора.

Устанавливаем способ регулировки яркости.

Определение типа подсветки матрицы может вызвать некоторые затруднения, а потому производитель подготовил несколько подсказок. В крайнем случае предлагается выбрать вариант «Общие».

Устанавливаем параметры калибровки. При желании пользователь может задать свои значения гаммы, точки белого и яркости.

После этого прибор замеряет уровень освещенности помещения и рекомендует оптимальные значения яркости и точки белого (обычно эталоном считается 6500 К, фотографы используют 5000 К). Для работы расхождение цветовой температуры монитора с температурой внешнего освещения больше, чем на 500 К, нежелательно. Если программа выдает яркость выше 120 кд/м 2 , следует затемнить комнату и повторить замеры.

На следующей странице показано, в какой части экрана следует разместить калибратор. После нажатия на кнопку «Далее» поступает указание ненадолго закрыть прибор крышкой, а потом настроить на мониторе оговоренное выше значение яркости.

После калибровки, которая длится около десяти минут, программа предложит сохранить новый цветовой профиль, который описывает цветовые характеристики монитора и способ их преобразования в стандартное цветовое пространство. После калибровки устройства создается файл с расширением *.icc /*.icm, который в дальнейшем используется системой в качестве загрузочного.

Чтобы пользователь оценил результаты калибровки, ему демонстрируют, как выглядит один и тот же набор тестовых изображений до и после процедуры.

Самым любознательным софт предлагает посмотреть, насколько монитор соответствует основным цветовым пространствам, и замерить яркость, контрастность и точку белого при различных уровнях яркости.

После создания цветового профиля регулировка яркости монитора допускается в пределах не более 10-15 %, иначе можно уйти от настроенной точки белого.

Вопрос: Как часто нужно калибровать монитор?

Ответ: По словам специалистов, один раз в полгода/год вполне достаточно. Хотя программа предлагает делать это каждый месяц.

Альтернативное ПО для калибраторов

Для тех, кто уже перерос автоматическую пошаговую калибровку и хочет дотошно руководить процессом, есть более сложный и, что не менее важно, бесплатный софт. Он существенно расширяет возможности любого калибратора, однако перед работой придется почитать мануалы и форумы, так как подружить калибратор с такими программами иногда бывает непросто.

ArgyllCMS — открытое программное обеспечение для построения профиля ICC с помощью калибратора. Своеобразный универсальный «драйвер».

ColorHCFR (HCFR Colorimeter) — великолепная (не побоимся этого слова) французская программа, которая предоставляет пользователю полные отчеты о возможностях монитора, телевизора, проектора. Софт недружелюбен ко многим моделям калибраторов, но танцы с бубном окупаются возможностями программы. Для работы требуется установка ArgyllCMS и базовое знание английского языка. Последняя актуальная версия на 2020 год — HCFR Colorimeter 3.5.2.

DisplayCAL (ранее dispcalGUI) — самая известная программа для калибровки, профилирования и тестирования мониторов. Также требует наличия ArgyllCMS. Обладает огромным количеством настроек и дает возможность делать более точную калибровку за счет увеличения количества измерений. Процедура может длиться от нескольких минут до нескольких часов. Софт проще, чем HCFR, лучше проработан визуально, легко находит калибратор и имеет русский интерфейс.

Процесс настройки точки белого и яркости

На просторах мировой сети есть множество видеоуроков по настройке мониторов с использованием DisplayCAL.

Заключение

Калибровать нужно:

- мониторы профессиональных фотографов, дизайнеров, видеомонтажеров. Когда работа связана с цветом, оправдана даже покупка собственного калибратора;

- дисплеи с возможностью аппаратной калибровки — странно не пользоваться функцией, за которую отданы немалые деньги. При таком типе калибровки происходит более точная настройка цветопередачи, а изменения вносятся в 3D-LUT самого монитора. Таких моделей на рынке немного и все они для профи.

Читайте также: